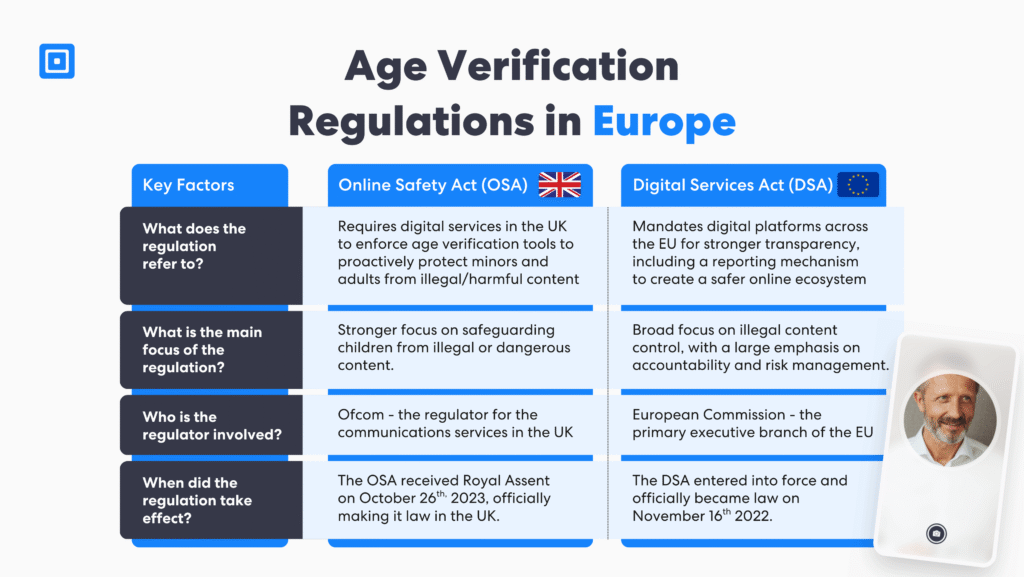

In breve: L'Online Safety Act 2023 del Regno Unito e il Digital Services Act dell'UE rappresentano ora un sfida seria alle aziende con carenza di multistrato controlli di verifica dell'età. Mentre la conformità al Digital Service Act e all'Online Safety Act mira a proteggere i bambini da contenuti dannosi e illeciti, entrambi hanno differenze chiave che sono essenziali affinché le aziende mantengano la conformità.

Come l'Online Safety Act e il Digital Safety Act proteggono gli utenti

Con la rapida evoluzione dei mercati digitali, cresce anche la necessità di proteggere gli utenti da contenuti dannosi e attività online illegali. L'Online Safety Act del 2023 e il Digital Services Act hanno stabilito norme fondamentali per creare un ambiente più sicuro su piattaforme, social media e servizi digitali che ospitano contenuti generati dagli utenti.

Il OSA pone l'accento sulla tutela dei diritti fondamentali dei minori. Richiedendo alle piattaforme online di contrastare proattivamente le attività dannose e implementando strumenti di verifica dell'età, la conformità all'Online Safety Act dà priorità alla rimozione dei contenuti illegali e offre agli utenti un maggiore controllo sui contenuti che incontrano. L'Online Safety Act introduce anche sanzioni penali per contrastare abusi online e comportamenti pericolosi.

Al contrario, il DSA riguarda tutte le piattaforme online che operano all'interno dell'Unione Europea, comprese le piattaforme online di grandi dimensioni (VLOP) e i grandi motori di ricerca online. Il DSA stabilisce regole per queste piattaforme digitali, imponendo loro di pubblicare relazioni annuali con informazioni relative alla sicurezza online. Devono inoltre divulgare il funzionamento dei loro algoritmi e fornire spiegazioni per le decisioni di rimozione dei contenuti.

Ambito di applicazione e giurisdizione dell'Online Safety Act 2023 e del Digital Services Act

L'Online Safety Act e il Digital Services Act affrontano la regolamentazione in modo diverso con sicurezza online e verifica dell'etàEntrambi si applicano ai servizi di messaggistica istantanea online, alle aziende di social media e ai forum online che consentono la pubblicazione di contenuti generati dagli utenti, indipendentemente dalla posizione geografica del fornitore. Il fattore chiave risiede nel fatto che il mercato di riferimento del servizio sia costituito da utenti nel Regno Unito o nell'Unione Europea.

Le aziende che gestiscono servizi digitali possono essere soggette a entrambi i quadri normativi, anche se hanno sede al di fuori di queste regioni. I servizi interessati includono un numero significativo di servizi di ricerca, piattaforme di social media, servizi di condivisione video, strumenti di condivisione file, messaggistica e forum online, servizi di incontri, motori di ricerca e provider di cloud hosting.

L'OSA impone un modello di conformità basato su regole e incentrato sul Regno Unito, mentre il DSA adotta un approccio stratificato e basato sul rischio, adattato alle dimensioni e alla funzione di ciascuna piattaforma. Nonostante queste differenze, entrambi i quadri normativi si applicano ai servizi digitali che ospitano contenuti degli utenti nel Regno Unito o nell'UE, o che sono destinati a tale paese. Di conseguenza, le aziende devono conformarsi indipendentemente dalla sede centrale.

Obblighi di verifica dell'età per le piattaforme online con l'Online Safety Act 2023 e il Digital Services Act

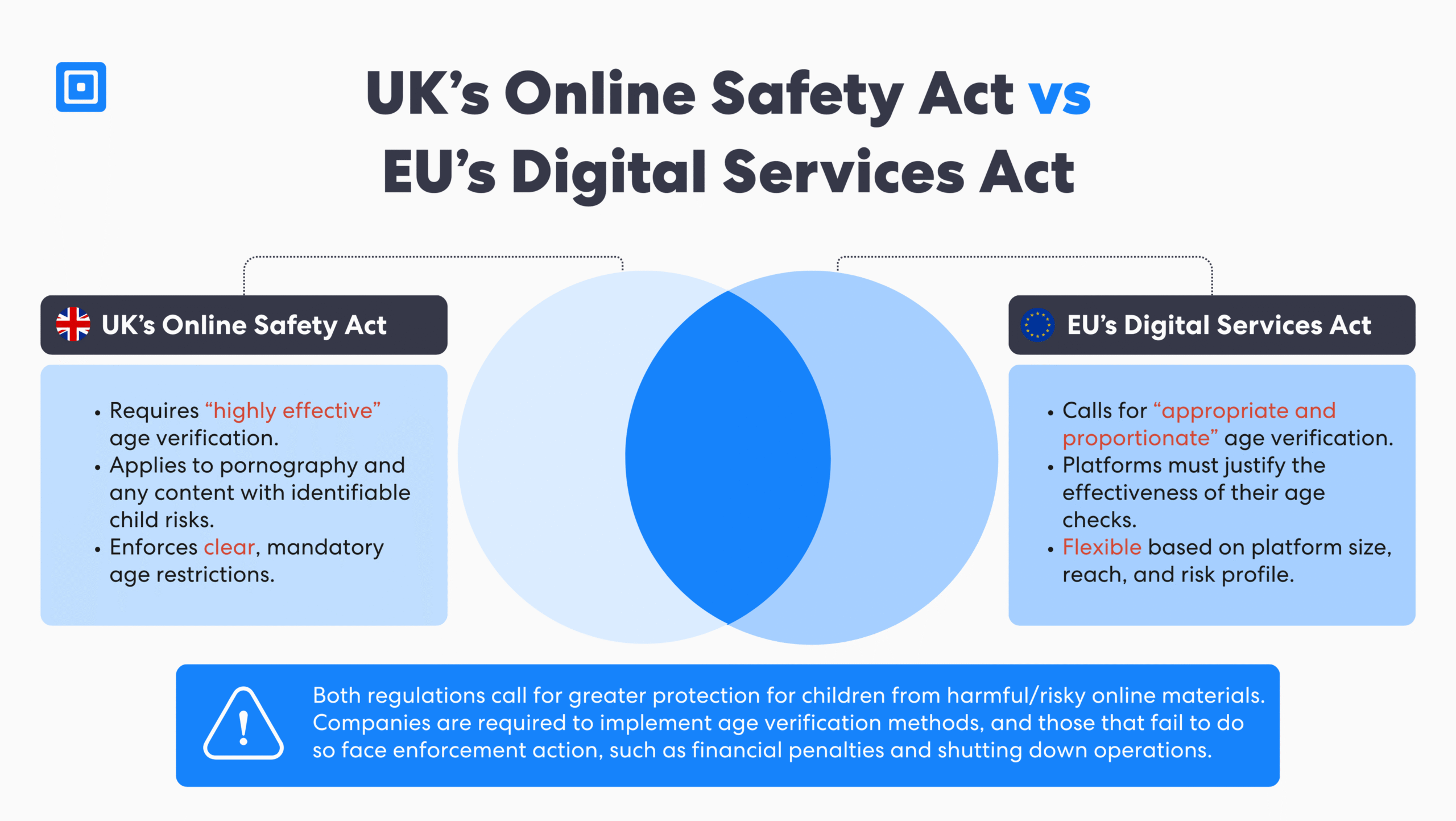

L'Online Safety Act 2023 (OSA) richiede alle piattaforme di implementare misure di sicurezza "altamente efficaci" meccanismi di verifica dell'età, in particolare per la pornografia e i contenuti che potrebbero danneggiare i minori. Tale obbligo si estende ai contenuti legali quando presentano rischi identificabili per i minori. L'OSA impone alle piattaforme di stabilire e applicare chiare restrizioni di età per impedire l'accesso ai minori.

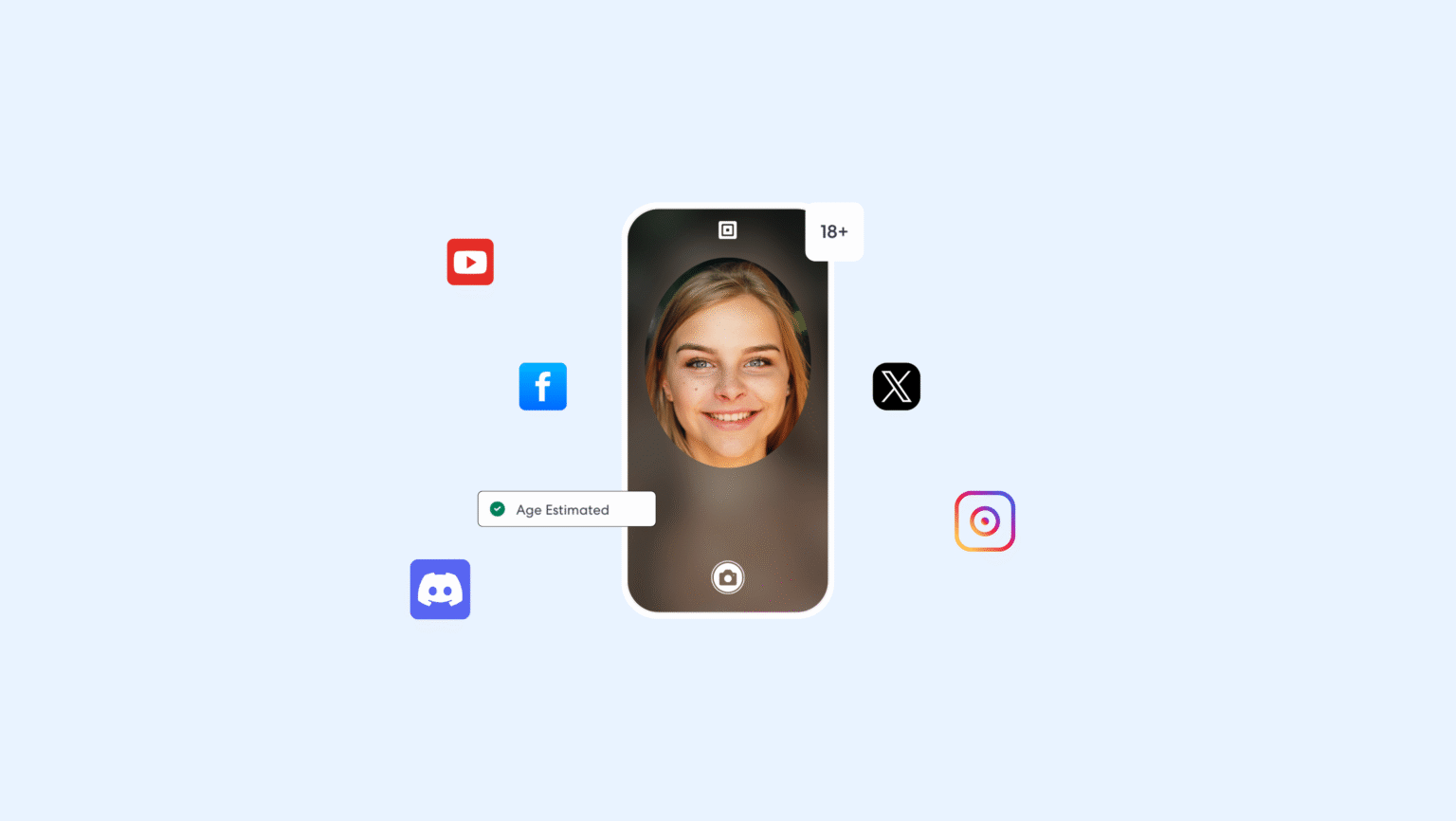

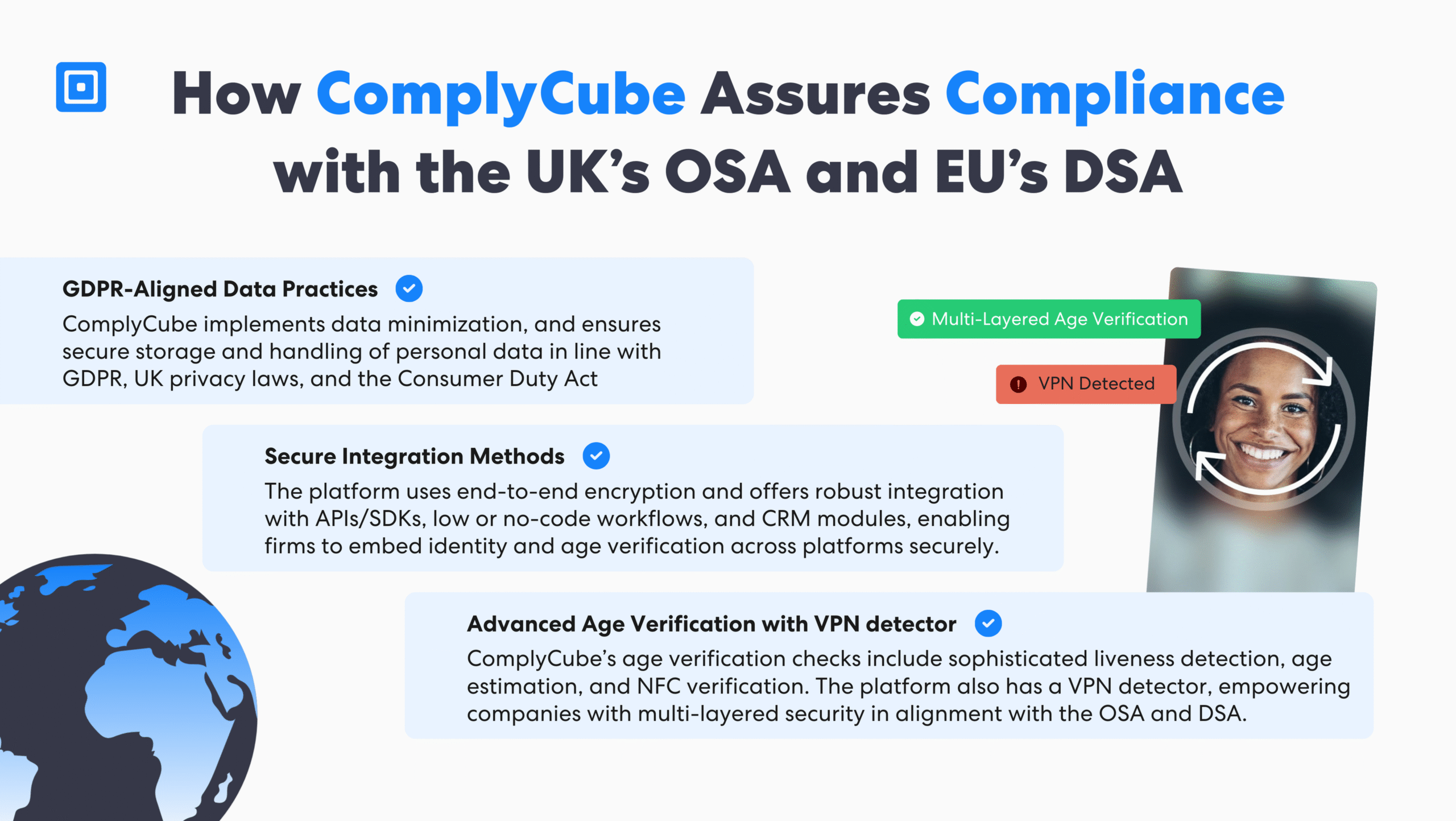

I metodi di verifica approvati includono controlli di identità rilasciati dal governo, autenticazione biometrica, stima dell'età facciale basata sull'intelligenza artificiale e sistemi resistenti a tattiche di elusione come l'uso di VPN. Ad esempio, se un utente tenta di nascondere la propria posizione utilizzando una VPN, ComplyCube può rilevare e contrassegnare la sessione, attivando un controllo di autenticazione biometrica, impedendo all'utente di proseguire finché non avrà verificato la propria età.

Al contrario, il Digital Services Act (DSA) richiede “appropriato e proporzionato”, offrendo maggiore flessibilità a seconda delle dimensioni, della portata e del profilo di rischio della piattaforma. Sebbene meno prescrittivo dell'OSA, il DSA obbliga comunque le piattaforme a dimostrare l'efficacia dei propri processi di verifica dell'età, soprattutto quando i minori possono essere esposti a contenuti dannosi.

L'applicazione normativa ai sensi del DSA richiede una chiara giustificazione delle modalità di applicazione pratica delle misure di protezione. Nonostante le differenze, entrambi gli atti condividono un obiettivo comune: tutelare i minori online attraverso limiti di età applicabili e chiari standard di responsabilità. Per saperne di più sulle frodi d'identità nel Regno Unito, clicca qui: Il prezzo della frode d'identità nel Regno Unito.

Obblighi di trasparenza e rendicontazione per l'Online Safety Act 2023 e il Digital Services Act

Sia l'Online Safety Act del 2023 che il Digital Services Act impongono alle piattaforme di pubblicare rapporti annuali sulla trasparenza. La prima serie di rapporti doveva essere presentata entro luglio 2025. Tali rapporti devono includere informazioni sulle richieste di rimozione dei contenuti, le metriche di moderazione e le più ampie iniziative di mitigazione del rischio.

Mentre il DSA si concentra sulla riduzione dei rischi sistemici attraverso obblighi flessibili e basati sul rischio, l'OSA impone una conformità operativa più rigorosa allineata con Approvato dall'Ofcom standard. Insieme, le leggi mirano a rafforzare la responsabilità e a garantire la sicurezza dei minori sulle piattaforme digitali attraverso comunicazioni regolari e verificabili.

Contenuti illegali e responsabilità della piattaforma per l'Online Safety Act 2023 e il Digital Services Act

L'OSA richiede alle piattaforme di affrontare in modo proattivo i contenuti illegali e dannosi, con specifici obblighi per prevenire danni illeciti. Le normative includono sanzioni fino a 10% del fatturato globale, ordini di blocco per violazioni persistenti, e dà priorità alla sicurezza dei minori riducendo i contenuti relativi ad autolesionismo e pedopornografia, e incoraggiando o favorendo gravi atti di autolesionismo.

Evidenzia ciò che ora è classificato come contenuto illegale e reato. Le azioni di contrasto vengono attivate quando sussiste un rischio concreto di danno significativo per gli utenti del Regno Unito. Le normative DSA includono multe fino a 6% di fatturato globale. Richiede una gestione da parte delle autorità nazionali con la supervisione della Commissione europea (CE) e un'attenzione particolare alle piattaforme online di grandi dimensioni (VLOP), nonché alla responsabilità algoritmica.

Caso di studio: TikTok sottoposto all'applicazione della legge DSA (2024)

Panoramica

Nel febbraio 2024, la Commissione europea ha avviato un'indagine su TikTok per sospette violazioni del Digital Services Act (DSA). L'inchiesta si è concentrata su aree chiave, tra cui la tutela dei minori, la trasparenza pubblicitaria e la gestione del rischio legato alla progettazione di piattaforme potenzialmente in grado di creare dipendenza.

Particolare attenzione è stata dedicata all'efficacia dei sistemi di verifica dell'età di TikTok e alla loro capacità di proteggere i minori da contenuti pericolosi. Sono stati inoltre analizzati la struttura della piattaforma e il suo contributo alla dipendenza da contenuti.

Azioni e risposte

L'indagine della Commissione europea su TikTok si è concentrata su tre aree critiche: i meccanismi di protezione dei minori, la trasparenza delle pratiche pubblicitarie e le politiche di accesso ai dati della piattaforma. Elemento centrale dell'inchiesta è stato il design algoritmico dei sistemi di TikTok e il loro potenziale ruolo nella promozione di comportamenti dannosi.

Risoluzione

Entro agosto 2024, la Commissione dell'Unione Europea ha pubblicato un comunicato stampa sull'accordo di TikTok rimuovere la funzione premi “TikTok Lite”Questa funzionalità era stata oggetto di analisi per il suo design accattivante, che incideva negativamente sull'esperienza utente dei minori. Questo caso sottolinea come l'applicazione dei DSA non sia puramente reattiva. Le autorità di regolamentazione stanno ora plasmando la progettazione delle piattaforme e tutelando i diritti fondamentali, soprattutto in aree critiche come il coinvolgimento dei giovani e il rischio algoritmico.

Controlli sulla pubblicità e sulla profilazione dei contenuti per i bambini online

Il Digital Services Act (DSA) vieta esplicitamente il targeting comportamentale dei minori, inclusa la pubblicità basata sulla profilazione e l'uso di interfacce utente dark pattern nei sistemi di raccomandazione dei contenuti. Queste nuove norme mirano a ridurre le pratiche manipolative che colpiscono in modo sproporzionato i minori su Internet.

Sebbene l'Online Safety Act 2023 (OSA) non disciplini direttamente il targeting pubblicitario, impone nuovi obblighi per impedire ai bambini di imbattersi in contenuti commerciali dannosi, in particolare sui motori di ricerca. Insieme, questi quadri normativi segnalano un irrigidimento normativo in materia di responsabilità delle piattaforme digitali nei confronti dei giovani utenti.

Maggiore controllo con standard di implementazione tecnici ed etici

Per conformarsi sia all'Online Safety Act 2023 (OSA) che al Digital Services Act (DSA), le piattaforme sono tenute a ridurre al minimo la raccolta di dati in linea con il GDPR, a evitare di archiviare informazioni sensibili relative all'età e a mantenere la trasparenza sui propri processi di verifica dell'età. Devono inoltre implementare misure di salvaguardia contro i rischi di reidentificazione e utilizzare metodi di integrazione sicuri come SDK o moduli senza codice.

La piattaforma di ComplyCube supporta questi requisiti attraverso la verifica sul dispositivo, il rilevamento biometrico della vitalità e Lettura chip NFCe riconoscimento multi-dispositivo, garantendo sia la conformità prescrittiva che l'implementazione adattabile su larga scala.

Governance, mitigazione del rischio e responsabilità senior

Ai sensi dell'Online Safety Act 2023 (OSA) e del Digital Services Act (DSA), le piattaforme sono obbligate a effettuare valutazioni periodiche dei rischi e a mitigare attivamente qualsiasi rischio materiale per gli utenti, in particolare i bambini. Queste valutazioni devono tenere conto dell'esposizione a contenuti quali pornografia, autolesionismo o disturbi alimentari, nonché dei rischi di abuso sistemico derivanti dai contenuti generati dagli utenti.

Inoltre, le piattaforme devono valutare l'impatto dei loro sistemi pubblicitari e di raccomandazione sui minori. L'OSA richiede la nomina di responsabili della conformità e la tenuta di registri pronti per la verifica, mentre la DSA impone solide politiche di governance dei contenuti e audit interni per le piattaforme online di grandi dimensioni (Very Large Online Platforms, VLOP).

Come OSA e DSA influenzano le PMI e le piattaforme di nicchia

Esiste un'idea errata diffusa secondo cui le piattaforme più piccole siano esenti dagli obblighi normativi. In realtà, l'Online Safety Act 2023 (OSA) si applica in base alla natura del rischio e dell'accessibilità dei contenuti, non alle dimensioni della piattaforma. Sebbene il Digital Services Act (DSA) offra agevolazioni procedurali per le piccole e medie imprese (PMI) con meno di 50 dipendenti o un fatturato annuo inferiore a 10 milioni di euro, non esonera dalle responsabilità fondamentali. Tutte le piattaforme, indipendentemente dalle dimensioni, sono tenute ad attuare misure di sicurezza proporzionate se è probabile che i loro servizi siano accessibili ai minori.

Integrazione con altre nuove norme sulla protezione dei dati

I requisiti di verifica dell'età si intersecano con diversi quadri normativi chiave. Ai sensi dell' Regolamento generale sulla protezione dei dati (GDPR), le piattaforme devono garantire la minimizzazione dei dati, stabilire una base giuridica per il trattamento e applicare i principi di privacy by design. Il regolamento eIDAS stabilisce standard di garanzia dell'identità digitale, particolarmente rilevanti per le verifiche basate sull'UE.

Inoltre, il Legge sui mercati digitali Sottopone le piattaforme di gatekeeper a un controllo di progettazione, tenendo conto anche di considerazioni legate all'età. La legislazione secondaria ai sensi dell'OSA e del DSA fornisce le soglie e le classificazioni dettagliate necessarie per rendere operativi questi obblighi per i diversi fornitori di servizi.

Ofcom indaga su 34 siti web pornografici per mancata verifica dell'età

Indagine sui contenuti prioritari primari

Il 31 luglio 2025, l'Ofcom ha avviato indagini formali su quattro fornitori di servizi digitali che gestivano complessivamente 34 siti web pornografici. Queste piattaforme erano sospettate di aver violato i requisiti OSA non implementando le nuove norme. L'indagine dell'Ofcom si è concentrata sull'adozione da parte delle piattaforme di sistemi di verifica dell'età conformi allo standard di "altamente efficace" richiesto dalla legge.

Potenziali sanzioni per la non conformità

L'esito di queste indagini potrebbe creare precedenti cruciali per la futura regolamentazione di piattaforme simili. Queste sanzioni possono arrivare fino a 18 milioni di sterline o 10% del fatturato mondiale ammissibile di una piattaforma, a seconda di quale sia l'importo più elevato. In casi estremi, Ofcom può anche ordinare ai fornitori di servizi Internet di bloccare l'accesso alle piattaforme incriminate nel Regno Unito.

Risultati e impatti

Sebbene le decisioni definitive delle indagini in corso siano ancora in sospeso, i primi dati suggeriscono che l'applicazione delle norme da parte dell'OSA stia già avendo un impatto misurabile. Le principali piattaforme di contenuti per adulti hanno registrato un calo sostanziale del traffico, con un rapporto che indica un calo di 47% nelle visite nel Regno Unito a seguito dell'implementazione della nuova norma. Questo netto calo indica che i sistemi di verifica dell'età vengono adottati attivamente, volontariamente o sotto pressione normativa.

Adottare una strategia di conformità unificata

Per conformarsi sia all'OSA che al DSA, le aziende dovrebbero adottare una strategia di conformità olistica. Le aziende devono investire in soluzioni dinamiche di gestione del rischio in grado di attivare flussi di lavoro automatizzati in base alla geolocalizzazione dell'utente o alla tipologia di documento.

La semplificazione dei cicli di test e iterazione diventa più efficiente quando si collabora con un fornitore di verifica dell'età Con SDK e API per un'integrazione perfetta. Inoltre, il monitoraggio dei codici di condotta in continua evoluzione può ulteriormente aiutare le organizzazioni a rimanere al passo con le normative in continua evoluzione. Per saperne di più, clicca qui: Cosa sono le soluzioni di verifica dell'identità?

Punti chiave

- Legge sulla sicurezza online Le normative in materia di conformità impongono rigorosi controlli sull'età e protocolli di sicurezza per tutelare i minori.

- La legge sui servizi digitali dell'UE applica un approccio proporzionato e basato sul rischio, personalizzato in base alla piattaforma.

- Sia l'OSA del Regno Unito che il DSA dell'UE attribuisce maggiore responsabilità alle aziende nella regolamentazione dei contenuti.

- Servizi più piccoli, comprese le startup, non sono esenti dal controllo ai sensi dell'OSA e del DSA.

- Le piattaforme devono adottare una garanzia etica dell'età che riconoscono i diritti fondamentali, una progettazione che tutela la privacy e strumenti di conformità unificati.

Rafforzare la conformità all'Online Safety Act 2023 con ComplyCube

La convergenza tra l'Online Safety Act 2023 (OSA) e il Digital Service Act (DSA) riflette un cambiamento nella responsabilità digitale. Le piattaforme devono andare oltre la moderazione reattiva e adottare principi di sicurezza fin dalla progettazione, soprattutto per i bambini. Le aziende che offrono pratiche di sicurezza aperte e incentrate sull'utente guadagneranno fiducia e consenso normativo in un panorama di conformità in continua evoluzione.

Esplora soluzioni personalizzate e senza soluzione di continuità soluzioni di garanzia dell'età multistrato sulla piattaforma ComplyCube. Integra i clienti in pochi secondi ed evita di dover affrontare pesanti sanzioni ai sensi dell'Online Safety Act e del Digital Services Act. Parla con un membro del ComplyCube squadra oggi.

Domande frequenti

L'OSA e il DSA si applicano alle piattaforme con un pubblico prevalentemente adulto?

Sebbene una piattaforma possa essere rivolta agli adulti, deve comunque conformarsi alle normative se i minori possono accedervi, in particolare in casi come i social media, dove i contenuti vengono condivisi tra diverse fasce d'età. Le piattaforme sono tenute ad adottare misure proporzionate, come l'implementazione di filtri per i contenuti e controlli parentali, per impedire che i minori siano esposti a contenuti dannosi o per adulti.

Cosa si intende per contenuto prioritario ai sensi dell'Online Safety Act (OSA)?

I contenuti prioritari includono la pornografia e materiale che promuove disturbi alimentari, autolesionismo o suicidio. Questo vale anche se il contenuto è legale, in quanto considerato dannoso per i minori.

In che modo OSA o DSA influenzano la verifica dell'età sulle piattaforme dei social media?

Ai sensi dell'OSA, la verifica dell'età è obbligatoria se è probabile che i minori accedano alla piattaforma. L'EU DSA richiede inoltre la verifica dell'età quando i contenuti presentano rischi, il che significa che la maggior parte delle principali piattaforme di social media deve adottare misure di verifica dell'età.

Le aziende o i dirigenti possono incorrere in sanzioni penali ai sensi di queste leggi?

L'OSA prevede che i dirigenti senior siano soggetti a responsabilità penale qualora le piattaforme non rispettino gli obblighi di sicurezza e di verifica dell'età. Il DSA prevede inoltre sanzioni, anche penali, a seconda delle modalità di attuazione del regolamento da parte dei singoli Stati membri dell'UE.

In che modo l'OSA e la DSA tutelano i diritti fondamentali e ne garantiscono il rispetto?

Entrambe le leggi includono misure di salvaguardia per bilanciare la regolamentazione con i diritti degli utenti. Imponendo alle piattaforme di rispettare la libertà di espressione e la privacy, applicando al contempo obblighi proporzionati di verifica dell'età, moderazione dei contenuti e segnalazione.