Resumen: Los deepfakes han evolucionado desde novedades de IA hasta amenaza serias a la estabilidad global, facilitación del fraude y desinformación a gran escala. Su impacto en elecciones, confianza pública y seguridad empresarial está creciendo rápidamente, exigiendo atención urgenteEsta guía explora cómo software de detección de deepfakes y Verificación de identidad o Soluciones IDV como la verificación biométrica y la verificación de documentos pueden ayudar mitigar riesgos y proteger la integridad digital.

¿Qué es un Deepfake?

Los deepfakes reciben su nombre de una técnica de Inteligencia Artificial (IA) conocida como aprendizaje profundo. En concreto, los algoritmos de aprendizaje profundo pueden aprender a resolver problemas extremadamente complejos. Al analizar grandes conjuntos de datos, pueden generar contenido hiperrealista, intercambiando rostros con fluidez en imágenes, vídeos, audio y más.

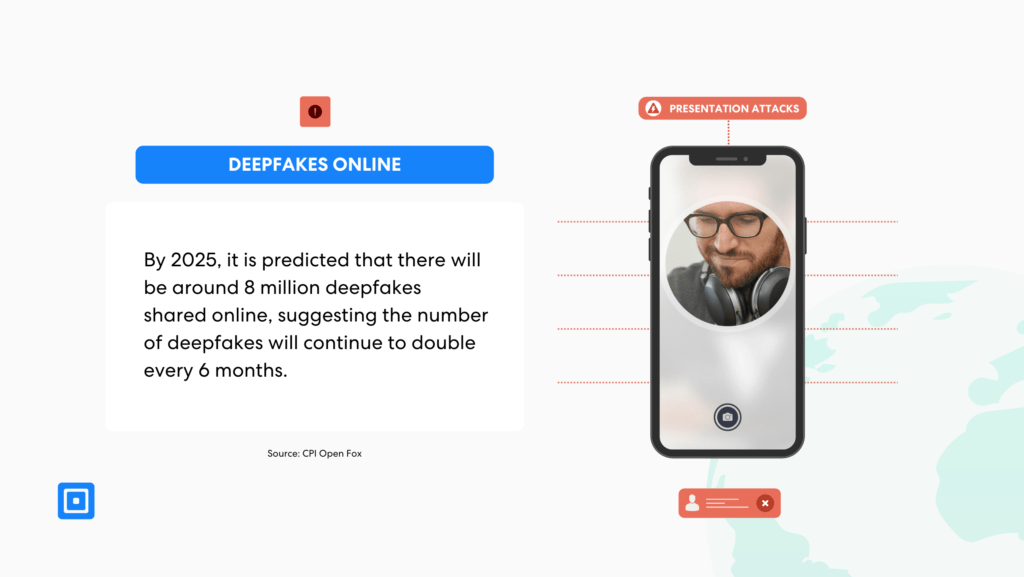

El mundo se encamina rápidamente hacia una crisis de deepfakes. Al mismo tiempo, crece la preocupación sobre cómo esta tecnología de IA afectará a las organizaciones. De hecho, ya está transformando el panorama socioeconómico y político global. Sin embargo, recientemente, los temores sobre la integridad electoral se han intensificado y han suscitado un escrutinio considerable.

¿Qué es la detección de deepfakes?

El software de detección de deepfakes identifica imágenes, sonidos o vídeos creados artificialmente para parecer hiperrealistas. Hoy en día, las empresas integran soluciones de verificación de identidad (IDV), como la verificación de documentos y la verificación biométrica, para detectar patrones que no existirían en el contenido real.

Las soluciones de verificación de identidad impulsadas por IA se están convirtiendo rápidamente en la única forma de contrarrestar de forma fiable la tecnología deepfake y mitigar este tipo de fraude de identidad. En comparación con un ser humano, estas tecnologías pueden identificar contenido falsificado con mucha más eficacia, pudiendo procesar muchos más datos en un período de tiempo determinado, con mucha más precisión y de forma mucho más rentable.

En septiembre de 2023, tres agencias policiales clave, la Agencia de Seguridad Nacional (NSA), la Oficina Federal de Investigaciones (FBI) y la Agencia de Seguridad Cibernética y de Infraestructura (CISA), publicaron un documento en el que declaraban que las amenazas de deepfake habían aumentado exponencialmente y que las tecnologías preventivas automatizadas, como el software de detección de deepfake, eran esenciales.

Amenazas de medios sintéticos, como Los deepfakes han aumentado exponencialmente.

A medida que las amenazas de deepfake se expanden en todos los sectores, la necesidad de verificación de identidad se vuelve más urgente. Las soluciones de verificación de identidad que combinan verificación de documentos, comprobaciones biométricas y detección de vida representan ahora una defensa crucial contra el fraude impulsado por IA.

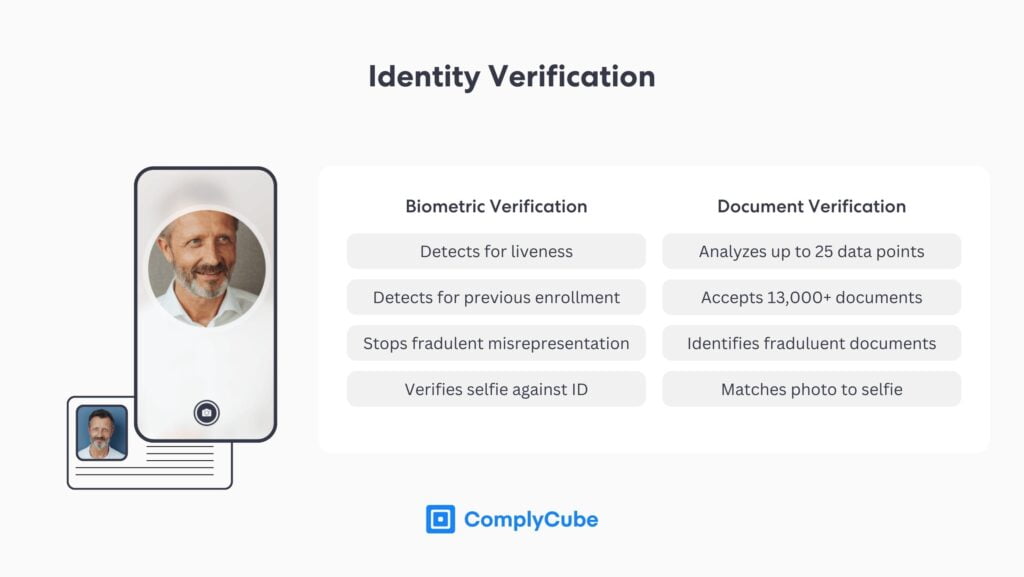

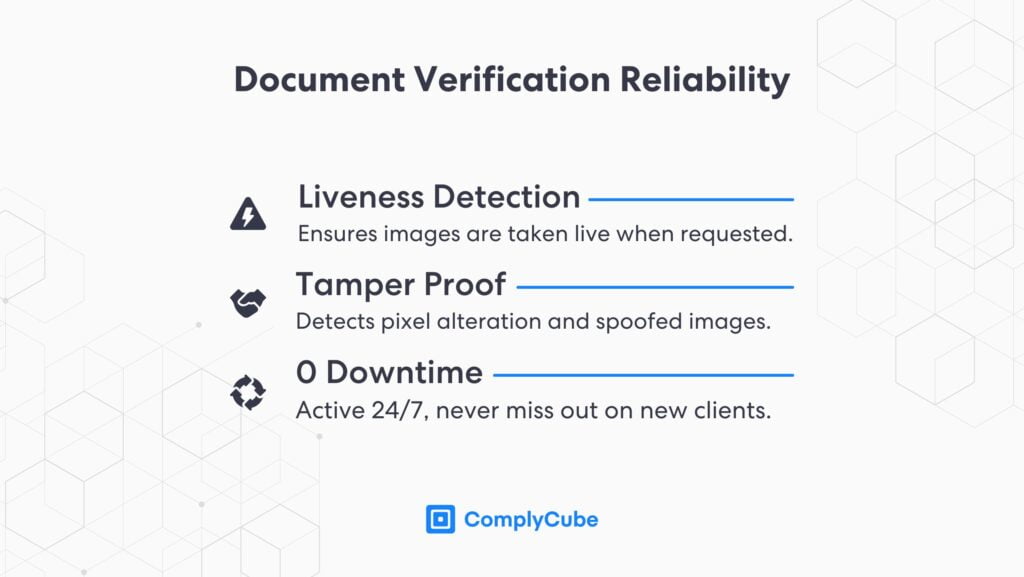

Verificación de documentos

Verificación de documentos Es uno de los dos pasos clave en los procesos de Prevención de Lavado de Dinero (AML), Conozca a su Cliente (KYC) e Identificación de Identificadores (IDV). Utiliza un motor de verificación basado en IA para leer documentos KYC, como una licencia de conducir, en menos de 15 segundos. De hecho, muchos intentos de fraude deepfake se detectan inicialmente mediante anomalías detectadas durante la verificación de documentos, lo que lo convierte en un componente esencial de cualquier tecnología de software de detección de deepfake.

Al verificar simultáneamente la autenticidad de los documentos y extraer los datos disponibles, la verificación de documentos proporciona un alto nivel de seguridad de la identidad. También actúa como un software preliminar de detección de deepfakes, capaz de identificar imágenes de documentos de identidad creadas artificialmente. Para más información sobre Gen AI, verificación de documentos y métodos de detección de deepfakes, lea Fraude generativo de IA y verificación de identidad.

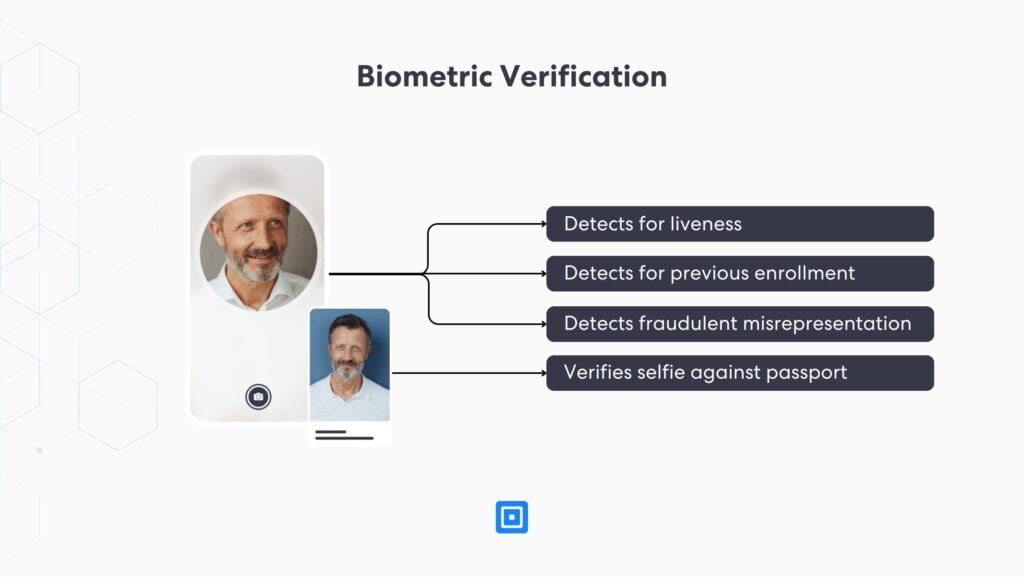

Verificación biométrica

Verificación biométrica Utiliza potentes tecnologías de identificación biométrica y reconocimiento facial para escanear, verificar y autenticar la biometría del usuario. Al analizar información biométrica, como rasgos faciales, microexpresiones, tonos de piel y textura (a veces utilizando datos alternativos como escaneos de iris), este proceso actúa como una herramienta de detección de vida y evita ataques de presentación, como deepfakes.

La autenticación biométrica sigue siendo una de las formas más fiables de verificar la identidad. Si bien los datos biométricos son extremadamente difíciles de falsificar, incluso con IA, detectar deepfakes sigue siendo complicado.

Las soluciones automatizadas de verificación de identidad (IDV) desempeñan un papel fundamental en la verificación de identidad, la incorporación de clientes y la autenticación modernas. Permiten a las organizaciones gestionar grandes volúmenes de verificaciones con precisión y a gran escala. Para más información, lea Las ventajas de la verificación biométrica.

Deepfakes e integridad electoral

Los actores maliciosos suelen usar deepfakes para socavar las elecciones. Pueden difundir información falsa y manipular la opinión pública. El Instituto Alan Turing descubrió que casi nueve de cada diez personas se preocupan por la influencia de los deepfakes en los resultados electorales.

Esta preocupación refleja riesgos reales. Agentes maliciosos ya han publicado vídeos de figuras políticas de alto perfil, incluyendo audios y vídeos falsos, con el objetivo de confundir a los votantes.

Antes de las elecciones generales del Reino Unido de 2024, actores desconocidos crearon deepfakes que imitaban las voces del primer ministro Rishi Sunak, el líder laborista Keir Starmer y el alcalde de Londres Sadiq Khan. Distribuyeron estos vídeos en redes sociales, llegando a cientos de miles de votantes potenciales y alimentando la confusión pública.

Estas manipulaciones incluyeron escándalos de corrupción falsos y afirmaciones engañosas sobre posturas e intenciones políticas. Como resultado, este tipo de contenido puede causar graves daños, sobre todo cuando a los votantes les cuesta distinguir lo real de lo falso.

Detección y respuesta ante deepfakes

La detección de deepfakes es cada vez más difícil, incluso para gigantes tecnológicos como Meta, Google y Microsoft, quienes se han comprometido a combatir la IA engañosa en las elecciones. El desafío radica en la creciente sofisticación de las herramientas de IA generativa, que ahora producen información prácticamente indistinguible de la realidad. Las empresas deben integrar soluciones de verificación de identidad (IDV) y API de detección en tiempo real para detener las amenazas antes de que se activen.

Por ejemplo, el presidente de Asuntos Globales de Meta, Nick Clegg, ha señalado los desafíos a la hora de identificar contenido generado por IA, Destacando que los actores maliciosos pueden eliminar los marcadores invisibles que generalmente indican manipulación..

La amenaza de los deepfakes es global. Incluso parece seguir los acontecimientos internacionales. En Estados Unidos, los deepfakes que imitan... La voz del presidente Joe Biden se utilizó en una llamada automática para compartir información falsa sobre las elecciones. Este incidente resalta el potencial que tienen los deepfakes para suprimir la participación electoral.

Este desafío va más allá de la detección. Una vez que un deepfake se propaga, suele causar daños antes de que los verificadores de datos puedan desmentirlo. Las plataformas deben actuar antes de que se publique contenido fraudulento. Redes sociales como X (anteriormente Twitter), Facebook e Instagram deberían adoptar software de detección de deepfakes con funciones de escaneo previo a la carga y detección de contenido en tiempo real mediante SDK y API.Para más información, lea Integración con un SDK de detección de vida.

Detección de deepfakes en la verificación de identidad

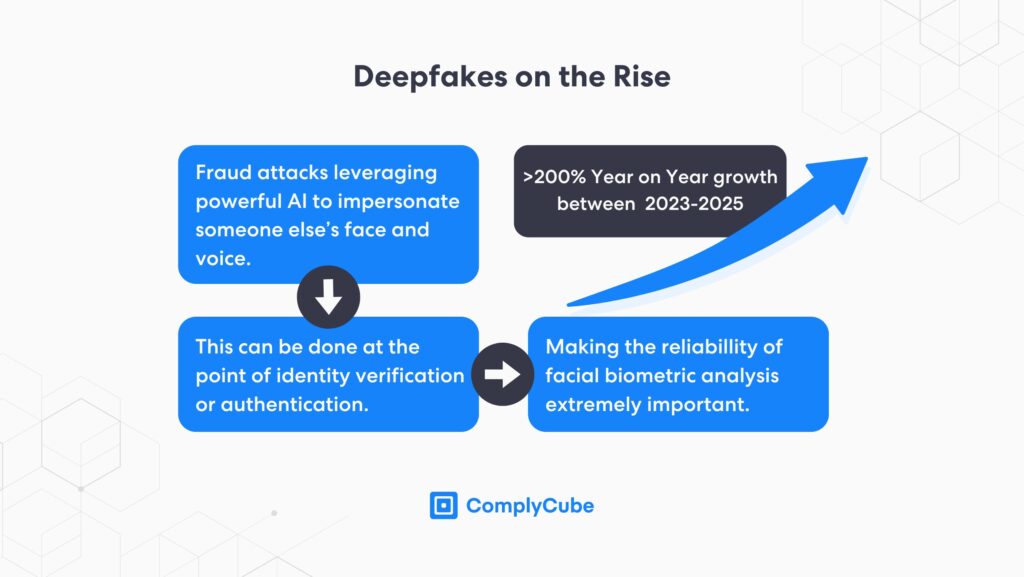

Más allá de las redes sociales, las deepfakes se han convertido en un importante vector de fraude en diversas industrias. Hoy en día, representan un riesgo clave de fraude en los servicios financieros, desde aplicaciones bancarias y de trading hasta plataformas de criptomonedas y servicios de pago. Los delincuentes utilizan deepfakes a diario para evadir la verificación de identidad (IDV), vaciar fondos y abrir cuentas con entidades crediticias.

La IA generativa representa la mayor amenaza para la industria [financiera], lo que podría permitir que las pérdidas por fraude alcancen los 1.600 millones de TBP en los EE. UU. en 2027, frente a los 12.300 millones de TBP en 2023.

Esta predicción sugiere que el fraude deepfake podría aumentar en más de 200% en cuatro años, convirtiéndose en el principal impulsor de la delincuencia financiera global. Para evitar este aumento, las organizaciones deben invertir en software avanzado de detección de deepfake, capaz de identificar contenido sintético antes de que provoque pérdidas financieras.

La erosión de la confianza a causa de la tecnología fraudulenta

Más allá de las elecciones, la proliferación de deepfakes plantea una amenaza más amplia a la confianza pública y privada en la información y la identidad. A medida que la tecnología deepfake se vuelve más común, las personas se vuelven cada vez más escépticas respecto de los medios que consumen. Este escepticismo en los medios podría conducir a un fenómeno conocido como el El dividendo del mentiroso, Donde la posibilidad de contenido falso otorga a las personas una negación plausible, socavando la rendición de cuentas y la veracidad. Las soluciones de verificación de identidad (IDV) podrían ayudar a las organizaciones a distinguir la verdad de la falsedad, restaurando la confianza digital en una era de engaños por IA.

Un ejemplo común de este fenómeno es la cobertura mediática perjudicial de una figura pública, un líder político o un líder empresarial. El escepticismo en los medios auténticos permite a estas personas aprovecharse de este sentimiento público y usarlo en su beneficio para afirmar que no es genuino. Es fácil ver cómo este efecto puede multiplicarse.

Caso práctico: Estafa deepfake del director ejecutivo de Arup y fraude de $25 millones

A principios de 2025, ciberdelincuentes utilizaron IA generativa para suplantar la identidad de altos ejecutivos de Arup, incluido el director ejecutivo, durante una videollamada falsa con un empleado de finanzas en la oficina de la compañía en Hong Kong. Creyendo que la solicitud era legítima, el empleado transfirió 1,7 millones de dólares estadounidenses a cuentas controladas por los estafadores.

El video deepfake reflejaba fielmente el estilo de comunicación interna de Arup y presentaba a varios "ejecutivos" falsos. Cabe destacar que los atacantes habían estudiado la jerarquía y los flujos de trabajo de la empresa, combinando la tecnología deepfake con ingeniería social dirigida. Como resultado, el empleado no encontró motivos para cuestionar la interacción. Para cuando las comprobaciones de identidad descubrieron el fraude, los fondos eran irrecuperables.

Este caso pone de relieve la facilidad con la que los deepfakes pueden evadir los métodos de verificación tradicionales. Por lo tanto, las organizaciones deben adoptar soluciones de verificación de identidad biométrica en tiempo real con software de verificación biométrica en tiempo real y detección de deepfakes para contrarrestar estas amenazas. En definitiva, el incidente de Arup sirve como una clara advertencia de que incluso las empresas globales con recursos suficientes siguen siendo vulnerables al fraude facilitado por deepfakes.

Generar confianza a gran escala con software de detección de deepfake

Si bien los peligros de las deepfakes son bien conocidos, las respuestas regulatorias siguen estando fragmentadas. En EE. UU., aún falta legislación a nivel nacional; sin embargo, al menos 20 estados han promulgado leyes contra las deepfakes relacionadas con las elecciones. Sin embargo, aún no se ha materializado una estrategia federal cohesiva. Mientras tanto, Departamento de El Tesoro ha respaldado tecnologías automatizadas como la verificación biométrica y la verificación de documentos como algunas de las herramientas más eficaces para prevenir y combatir las técnicas de fraude emergentes.

El Reino Unido también ha experimentado avances limitados. Si bien las leyes prohíben la creación y distribución de deepfakes personales dañinos, aún no se han promulgado regulaciones más amplias que regulan su uso en la manipulación electoral.

Por ahora, es responsabilidad de cada empresa implementar soluciones de verificación de identidad (IDV) que incluyan software de detección de deepfakes como herramienta de primera línea para combatir el fraude facilitado por deepfakes. Además, las organizaciones deben considerar las amenazas de deepfakes en su Enfoque Basado en Riesgos (EBR) al diseñar una estrategia contra el blanqueo de capitales (ALD).

Conclusiones clave

- Los deepfakes están impulsando un aumento en el fraude de identidad, pasando por alto las soluciones IDV estándar.

- La integridad electoral está cada vez más en riesgo, ya que los medios sintéticos se utilizan para difundir desinformación y manipular la percepción pública.

- La verificación biométrica juega un papel crucial en la lucha contra los deepfakes, utilizando reconocimiento facial, detección de vida y análisis de microexpresiones.

- La verificación de documentos impulsada por IA es esencial para detectar identificaciones falsas o sintéticas., permitiendo a las empresas verificar la autenticidad de los documentos.

- ComplyCube proporciona una plataforma unificada que integra verificación de identidad, verificación de documentos y software de detección de deepfakes para una protección completa contra el fraude.

Acerca de ComplyCube

Para combatir el fraude impulsado por IA, el software de detección de deepfakes y las soluciones de verificación de identidad (IDV) se han vuelto esenciales. Estas herramientas utilizan IA generativa para analizar los mismos patrones de datos utilizados para crear deepfakes, lo que ayuda a detectar contenido sintético y prevenir el fraude. Las soluciones de verificación de documentos y biométrica de ComplyCube desempeñan un papel clave en este proceso, permitiendo a organizaciones de todo el mundo autenticar usuarios y bloquear intentos de deepfakes.

El proveedor líder de soluciones de verificación de identidad (IDV) fue creado para combatir las crecientes amenazas de las metodologías fraudulentas innovadoras en el siglo XXI. Al aprovechar algoritmos avanzados de inteligencia artificial y aprendizaje automático, la plataforma de ComplyCube ofrece servicios integrales de verificación de identidad y biometría, lo que garantiza una protección sólida contra el fraude de identidad y el contenido deepfake.

Con una solución flexible y personalizable, sus servicios se pueden adaptar según el RBA de una empresa para ayudar a las empresas a mejorar sus protocolos de seguridad, mantener el cumplimiento de los estándares regulatorios y generar confianza con sus clientes en un mundo cada vez más digital. Para obtener más información, Comuníquese con un especialista en cumplimiento hoy mismo.

Preguntas frecuentes

¿Qué es un deepfake y cómo funciona?

Un deepfake es un tipo de contenido multimedia sintético, como video, imagen o audio, creado mediante algoritmos de aprendizaje profundo. Estos sistemas de IA se entrenan con grandes conjuntos de datos para replicar rasgos humanos sutiles, como expresiones faciales y patrones de habla. Como resultado, los deepfakes pueden imitar de forma convincente las voces, rostros y comportamientos de personas reales. Los cibercriminales los utilizan con frecuencia para difundir desinformación, suplantar la identidad de personas o cometer fraude de identidad.

¿Cómo saber si un vídeo, audio o imagen es un deepfake?

Los deepfakes se pueden identificar mediante herramientas de detección basadas en IA que analizan inconsistencias. Sin embargo, el software de detección de deepfakes busca anomalías en la simetría facial, patrones de parpadeo, iluminación o distorsiones del fondo. Además, los sistemas avanzados también pueden escanear metadatos y detectar artefactos de manipulación invisibles para el ojo humano. Si bien la detección manual no es fiable, las soluciones automatizadas pueden identificar contenido sintético con gran precisión.

¿Qué es la verificación biométrica y cómo detiene los deepfakes?

La verificación biométrica es un tipo de verificación de identidad que autentica la identidad de una persona mediante el análisis de rasgos biológicos únicos. Esta verificación considera, generalmente, los rasgos faciales durante una interacción en vivo. Utiliza la detección de vida para garantizar la presencia de una persona real. Esto evita intentos de suplantación de identidad mediante imágenes estáticas, vídeos o rostros generados por IA. Dado que los medios sintéticos tienen dificultades para superar estas comprobaciones en tiempo real, la verificación biométrica sigue siendo una de las herramientas más eficaces para bloquear los deepfakes.

¿Cómo afectan los deepfakes a las elecciones y a la democracia?

Los deepfakes se utilizan cada vez más para difundir narrativas políticas falsas, suplantar la identidad de candidatos y confundir a los votantes. Por ejemplo, pueden suplantar la identidad de candidatos políticos, difundir narrativas falsas y erosionar la confianza de los votantes. En consecuencia, esto socava la legitimidad electoral y daña los cimientos de las instituciones democráticas. La interferencia electoral mediante deepfakes es ahora un problema de seguridad reconocido en varios países.

¿Qué hace que ComplyCube sea eficaz como software de detección de deepfakes?

ComplyCube combina verificación de documentos con IA, autenticación biométrica y verificación de identidad en tiempo real para detectar fraudes basados en deepfakes. Su tecnología de detección de vida identifica medios sintéticos y detiene identidades fraudulentas antes del onboarding. Además, ComplyCube analiza documentos y datos faciales en busca de indicios de manipulación, lo que garantiza la neutralización de las amenazas de deepfakes sin comprometer la experiencia del usuario ni el cumplimiento normativo. Con la confianza de empresas globales, ComplyCube garantiza la mitigación de las amenazas de deepfakes sin comprometer la experiencia del usuario ni el cumplimiento normativo.