TL;DR : Les Deepfakes sont passés des nouveautés de l'IA à menace sérieuses à la stabilité mondiale, faciliter la fraude et la désinformation à grande échelle. Leur impact sur élections, confiance du public et sécurité des entreprises se développe rapidement et exige attention urgenteCe guide explore comment logiciel de détection de deepfake et Vérification d'identité ou Solutions IDV telles que la vérification biométrique et la vérification des documents peuvent aider atténuer les risques et protéger l'intégrité numérique.

Qu'est-ce qu'un Deepfake ?

Les deepfakes tirent leur nom d'une technique d'intelligence artificielle (IA) appelée apprentissage profond. Plus précisément, les algorithmes d'apprentissage profond peuvent apprendre par eux-mêmes à résoudre des problèmes extrêmement complexes. En analysant de vastes ensembles de données, ils peuvent ensuite générer du contenu hyperréaliste, intégrant de manière fluide des visages à des images, des vidéos, des fichiers audio, etc.

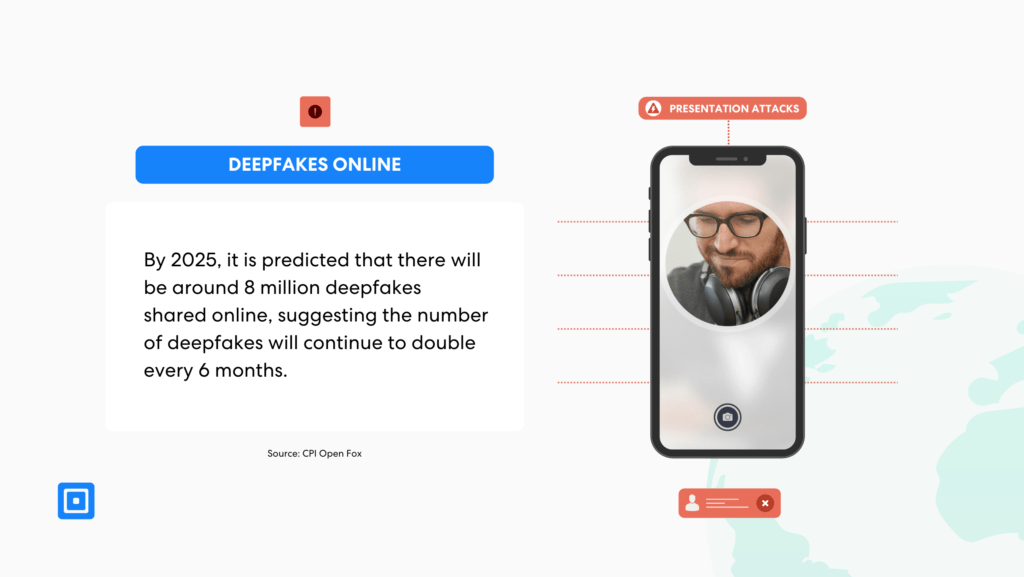

Le monde se dirige rapidement vers une crise des deepfakes. Parallèlement, les inquiétudes grandissent quant à l'impact de cette technologie d'IA sur les organisations. En réalité, elle transforme déjà le paysage socio-économique et politique mondial. Plus récemment, cependant, les craintes concernant l'intégrité des élections se sont intensifiées et ont suscité une attention particulière.

Qu'est-ce que la détection Deepfake ?

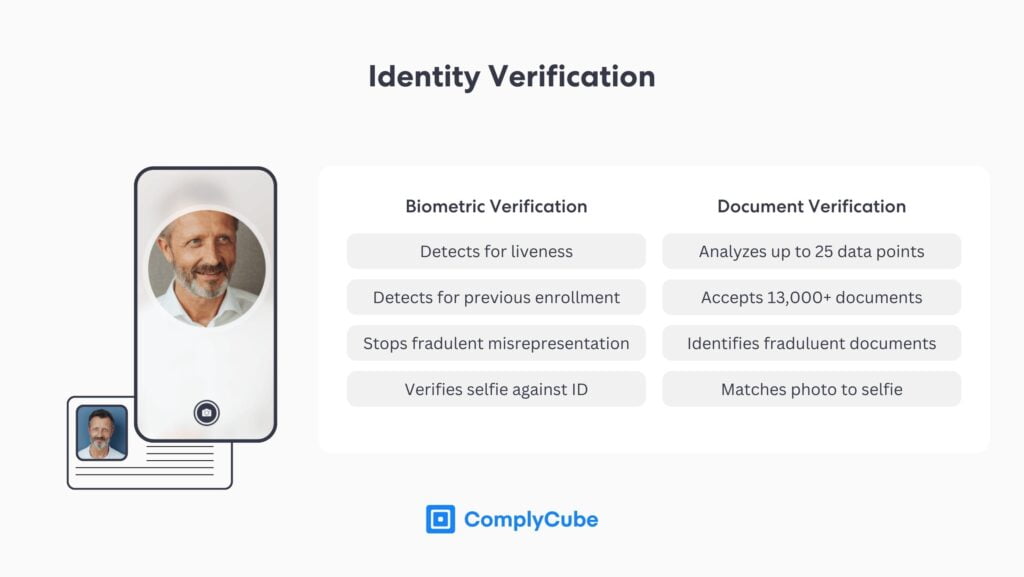

Les logiciels de détection de deepfakes identifient les images, les sons ou les vidéos créés artificiellement pour paraître hyperréalistes. Aujourd'hui, les entreprises intègrent des solutions de vérification d'identité, telles que la vérification de documents et la vérification biométrique, pour détecter des schémas qui n'existeraient pas dans un contenu réel.

Les solutions d’identification basées sur l’IA deviennent rapidement le seul moyen fiable de contrer la technologie deepfake et d’atténuer ce type de fraude à l’identité. Comparativement à un humain, ces technologies peuvent identifier le contenu falsifié beaucoup plus efficacement, en étant capables de traiter beaucoup plus de données sur une période donnée, avec beaucoup plus de précision et de manière beaucoup plus rentable.

En septembre 2023, trois agences clés chargées de l'application de la loi, la National Security Agency (NSA), le Federal Bureau of Investigation (FBI) et la Cybersecurity and Infrastructure Security Agency (CISA), ont publié un document déclarant que les menaces de deepfake avaient augmenté de façon exponentielle et que les technologies de prévention automatisées telles que les logiciels de détection de deepfake étaient essentielles.

Menaces provenant des médias synthétiques, tels que Les deepfakes ont augmenté de façon exponentielle.

Face à la multiplication des menaces de deepfake dans tous les secteurs, la vérification d'identité devient plus urgente. Les solutions de vérification d'identité combinant vérification de documents, contrôles biométriques et détection d'activité représentent désormais une défense essentielle contre la fraude par IA.

Vérification des documents

Vérification des documents Il s'agit de l'une des deux étapes clés des processus de lutte contre le blanchiment d'argent (LBA), de connaissance du client (KYC) et de vérification d'identité (IDV). Ce système utilise un moteur de vérification basé sur l'IA pour lire les documents KYC, comme un permis de conduire, en moins de 15 secondes. En effet, de nombreuses tentatives de fraude par deepfake sont d'abord détectées grâce à des anomalies détectées lors de la vérification des documents, ce qui en fait un composant essentiel de toute technologie logicielle de détection de deepfakes.

Vérifiant simultanément l'authenticité des documents et extrayant les données disponibles, la vérification des documents offre un niveau élevé d'assurance d'identité. Elle agit également comme un logiciel préliminaire de détection des deepfakes, capable d'identifier les images artificielles de cartes d'identité. Pour plus d'informations sur l'IA de génération, la vérification des documents et les méthodes de détection des deepfakes, consultez la page Fraude à l'IA générative et vérification d'identité.

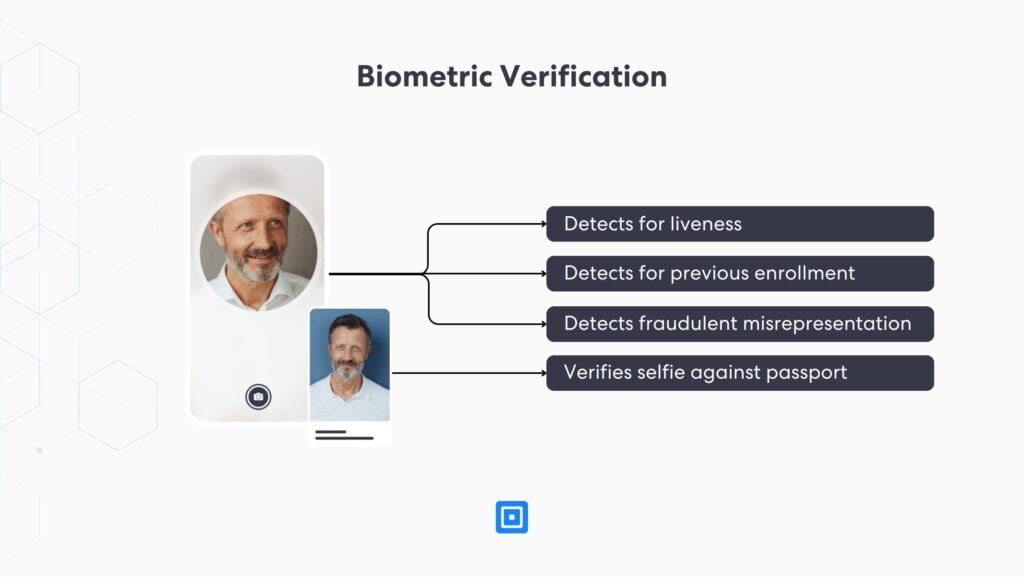

Vérification biométrique

Vérification biométrique utilise de puissantes technologies d'identification biométrique et de reconnaissance faciale pour scanner, vérifier et authentifier les données biométriques des utilisateurs. En analysant les informations biométriques, telles que les traits du visage, les micro-expressions, les tons de peau et la texture (parfois à l'aide de données alternatives telles que les scans d'iris), ce processus agit comme un outil de détection de vivacité et empêche les attaques de présentation, telles que les deepfakes.

L'authentification biométrique demeure l'un des moyens les plus fiables de vérifier l'identité. Si les données biométriques sont extrêmement difficiles à falsifier, même avec l'IA, la détection des deepfakes reste loin d'être simple.

Les solutions automatisées de vérification d'identité jouent un rôle essentiel dans la vérification d'identité moderne, l'intégration des clients et l'authentification. Elles permettent aux organisations de gérer d'importants volumes de vérifications avec précision et à grande échelle. Pour en savoir plus, consultez Les avantages de la vérification biométrique.

Les deepfakes et l'intégrité des élections

Les acteurs malveillants utilisent souvent les deepfakes pour saboter les élections. Ils peuvent diffuser de fausses informations et manipuler l'opinion publique. L'Institut Alan Turing a constaté que près de neuf personnes sur dix craignent que les deepfakes n'influencent les résultats des élections.

Cette inquiétude reflète des risques réels. Des acteurs malveillants ont déjà diffusé des informations confidentielles de personnalités politiques, notamment des extraits audio et vidéo fabriqués dans le but de semer la confusion chez les électeurs.

À l'approche des élections générales britanniques de 2024, des inconnus ont créé des deepfakes imitant les voix du Premier ministre Rishi Sunak, du chef du Parti travailliste Keir Starmer et du maire de Londres Sadiq Khan. Ils ont diffusé ces extraits sur les réseaux sociaux, touchant des centaines de milliers d'électeurs potentiels et alimentant les idées reçues.

Ces manipulations comprenaient de faux scandales de corruption et des allégations trompeuses sur des positions et intentions politiques. Par conséquent, de tels contenus peuvent causer de graves préjudices, en particulier lorsque les électeurs ont du mal à distinguer le vrai du faux.

Détection et réponse aux deepfakes

La détection des deepfakes devient de plus en plus difficile, même pour des géants de la technologie comme Meta, Google et Microsoft, qui se sont tous engagés à lutter contre l'IA trompeuse lors des élections. Ce défi découle de la sophistication croissante des outils d'IA générative, qui produisent désormais des résultats quasiment indiscernables de la réalité. Les entreprises doivent intégrer des solutions de vérification d'identité et des API de détection en temps réel pour bloquer les menaces avant même leur déploiement.

Par exemple, le président des affaires mondiales de Meta, Nick Clegg, a souligné les défis liés à l’identification du contenu généré par l’IA, soulignant que les acteurs malveillants peuvent supprimer les marqueurs invisibles qui indiquent généralement une manipulation.

La menace des deepfakes est mondiale. Elle semble même suivre les événements internationaux. Aux États-Unis, les deepfakes imitent La voix du président Joe Biden a été utilisée dans un appel automatisé pour partager de fausses informations sur l'élection. Cet incident met en évidence le potentiel des deepfakes pour réduire la participation électorale.

Ce défi va au-delà de la détection. Une fois propagé, un deepfake cause souvent des dommages avant même que les vérificateurs de faits puissent le démystifier. Les plateformes doivent agir avant la mise en ligne de contenus frauduleux. Les réseaux sociaux comme X (anciennement Twitter), Facebook et Instagram devraient adopter des logiciels de détection de deepfakes dotés de capacités d'analyse avant téléchargement et de détection de l'activité en temps réel via des SDK et des API.Pour plus d'informations, lisez Intégration avec un SDK de détection de vivacité.

Détection de deepfakes dans la vérification d'identité

Au-delà des réseaux sociaux, les deepfakes sont devenus un vecteur de fraude majeur dans tous les secteurs. Aujourd'hui, ils représentent un risque majeur pour les services financiers, des applications bancaires et de trading aux plateformes de cryptomonnaies et aux services de paiement. Les criminels utilisent quotidiennement les deepfakes pour contourner la vérification d'identité, drainer des fonds et ouvrir des comptes auprès d'organismes de crédit.

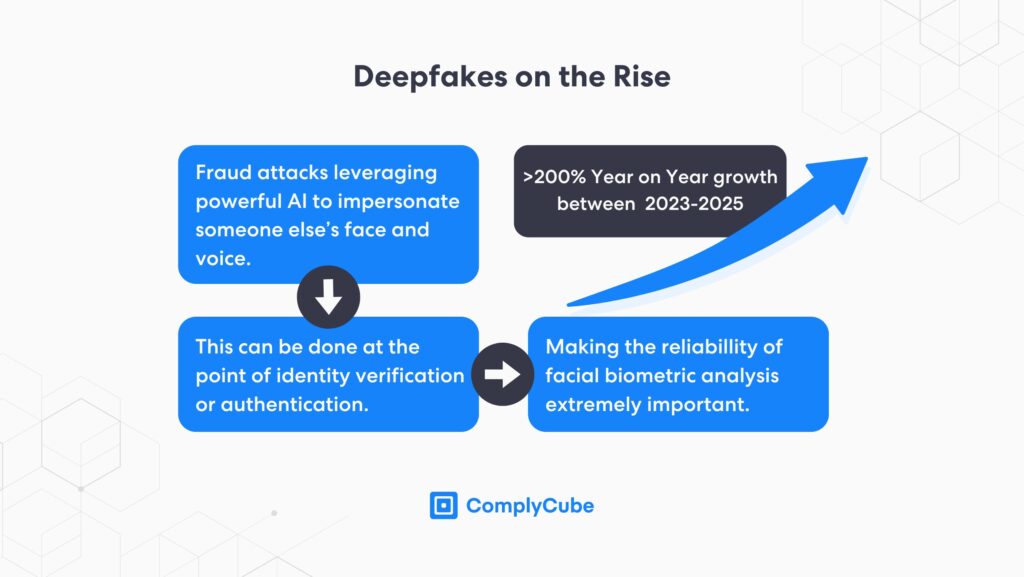

L’IA générative représente la plus grande menace pour le secteur [financier], ce qui pourrait potentiellement permettre aux pertes dues à la fraude d'atteindre 16,4 milliards de dollars américains d'ici 2027, contre 12,3 milliards de dollars en 2023.

Cette prévision suggère que la fraude par deepfake pourrait augmenter de plus de 200% d'ici quatre ans, devenant ainsi la principale cause de criminalité financière mondiale. Pour enrayer cette flambée, les organisations doivent investir dans des logiciels avancés de détection des deepfakes, capables d'identifier les contenus synthétiques avant qu'ils n'entraînent des pertes financières.

L'érosion de la confiance due à la technologie frauduleuse

Au-delà des élections, la prolifération des deepfakes constitue une menace plus large pour la confiance du public et du privé dans l’information et l’identité. À mesure que la technologie des deepfakes se répand, les gens deviennent de plus en plus sceptiques à l’égard des médias qu’ils consomment. Ce scepticisme des médias pourrait conduire à un phénomène connu sous le nom de dividende du menteur, Là où la possibilité de faux contenus offre aux individus un déni plausible, compromettant ainsi la responsabilité et la véracité des faits. Les solutions de vérification d'identité pourraient aider les organisations à distinguer le vrai du faux, restaurant ainsi la confiance numérique à l'ère de la tromperie de l'IA.

Un exemple courant de ce phénomène est la couverture médiatique négative d’une personnalité publique, d’un dirigeant politique ou d’un chef d’entreprise. Le scepticisme à l’égard des médias authentiques permet à ces individus de jouer sur ce sentiment public et de l’utiliser à leur avantage pour prétendre qu’il n’est pas authentique. Il est facile de comprendre comment cet effet pourrait se produire.

Étude de cas : arnaque au deepfake du PDG d'Arup et fraude de 1 725 millions de livres sterling

Début 2025, des cybercriminels ont utilisé l'IA générative pour se faire passer pour des cadres supérieurs d'Arup, dont le PDG, lors d'un faux appel vidéo avec un employé du service financier du bureau de Hong Kong. Croyant la demande légitime, l'employé a transféré 1725 millions de livres sterling (environ 1,7 milliard de livres sterling) vers des comptes contrôlés par les fraudeurs.

La vidéo deepfake reflétait fidèlement le style de communication interne d'Arup et mettait en scène plusieurs « dirigeants » artificiels. Il est à noter que les attaquants avaient étudié la hiérarchie et les processus de l'entreprise, combinant la technologie deepfake à une ingénierie sociale ciblée. Par conséquent, l'employé n'a trouvé aucune raison de remettre en question l'interaction. Lorsque les vérifications d'identité ont révélé la fraude, les fonds étaient irrécupérables.

Ce cas illustre la facilité avec laquelle les deepfakes peuvent contourner les méthodes de vérification traditionnelles. Par conséquent, les organisations doivent adopter des solutions d'identification biométrique en temps réel, dotées d'un logiciel de vérification biométrique et de détection des deepfakes, pour contrer ces menaces. En définitive, l'incident Arup constitue un avertissement clair : même les entreprises internationales disposant de ressources importantes restent vulnérables aux fraudes liées aux deepfakes.

Instaurer la confiance à grande échelle grâce à un logiciel de détection de deepfakes

Si les dangers des deepfakes sont bien connus, les réponses réglementaires restent fragmentées. Aux États-Unis, une législation nationale fait encore défaut, mais au moins 20 États ont adopté des lois ciblant les deepfakes liés aux élections. Une stratégie fédérale cohérente reste toutefois à mettre en place. Département de Le Trésor a approuvé les technologies automatisées telles que la vérification biométrique et la vérification des documents comme certains des outils les plus efficaces pour prévenir et combattre les nouvelles techniques de fraude.

Le Royaume-Uni a également enregistré des progrès limités. Si la législation interdit la création et la diffusion de deepfakes personnels préjudiciables, aucune réglementation plus large visant leur utilisation à des fins de manipulation électorale n'a encore été adoptée.

Pour l'instant, il incombe à chaque entreprise de mettre en œuvre des solutions de vérification d'identité (IDV) intégrant un logiciel de détection des deepfakes comme outil de première ligne pour lutter contre la fraude par deepfakes. De plus, les organisations doivent intégrer les menaces liées aux deepfakes dans leur approche fondée sur les risques (RBA) lors de l'élaboration de leur stratégie de lutte contre le blanchiment d'argent (AML).

Points clés à retenir

- Les deepfakes alimentent une augmentation des fraudes d'identité, contournant les solutions IDV standard.

- L’intégrité des élections est de plus en plus menacée, car les médias synthétiques sont utilisés pour diffuser de la désinformation et manipuler la perception du public.

- La vérification biométrique joue un rôle crucial dans la lutte contre les deepfakes, en utilisant la reconnaissance faciale, la détection du vivant et l'analyse des micro-expressions.

- La vérification des documents alimentée par l'IA est essentielle pour détecter les pièces d'identité falsifiées ou synthétiques, permettant aux entreprises de vérifier l’authenticité des documents.

- ComplyCube fournit une plateforme unifiée qui intègre la vérification d'identité, la vérification de documents et un logiciel de détection de deepfake pour une protection complète contre la fraude.

À propos de ComplyCube

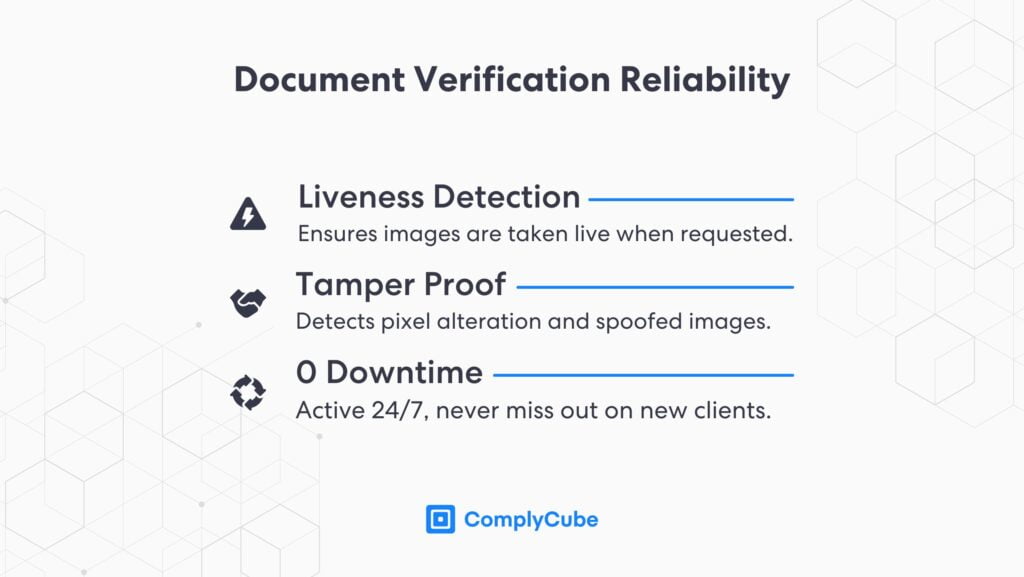

Pour lutter contre la fraude par IA, les logiciels de détection des deepfakes et les solutions de vérification d'identité (IDV) sont devenus essentiels. Ces outils utilisent l'IA générative pour analyser les mêmes schémas de données que ceux utilisés pour créer les deepfakes, contribuant ainsi à la détection des contenus synthétiques et à la prévention de la fraude. Les solutions de vérification de documents et biométriques de ComplyCube jouent un rôle clé dans ce processus, permettant aux organisations du monde entier d'authentifier leurs utilisateurs et de bloquer les tentatives de deepfakes.

Le principal fournisseur de solutions d'identification des identités a été créé pour lutter contre les menaces croissantes des méthodologies frauduleuses innovantes au 21e siècle. En s'appuyant sur des algorithmes avancés d'IA et d'apprentissage automatique, la plateforme de ComplyCube offre des services complets de vérification d'identité et biométrique, garantissant une protection robuste contre la fraude à l'identité et les contenus deepfake.

Bénéficiant d'une solution flexible et personnalisable, leurs services peuvent être adaptés en fonction de la RBA d'une entreprise pour aider les entreprises à améliorer leurs protocoles de sécurité, à maintenir la conformité aux normes réglementaires et à instaurer la confiance avec leurs clients dans un monde de plus en plus numérique. Pour plus d'informations, Contactez un spécialiste de la conformité dès aujourd'hui.

Questions fréquemment posées

Qu'est-ce qu'un deepfake et comment fonctionne-t-il ?

Un deepfake est une forme de média synthétique, tel qu'une vidéo, une image ou un son, créé à l'aide d'algorithmes d'apprentissage profond. Ces systèmes d'IA s'entraînent sur de vastes ensembles de données pour reproduire des traits humains subtils, notamment les expressions faciales et les schémas de parole. Ainsi, les deepfakes peuvent imiter de manière convaincante la voix, le visage et le comportement de personnes réelles. Les acteurs malveillants les utilisent fréquemment pour diffuser de fausses informations, se faire passer pour des personnes ou commettre des fraudes d'identité.

Comment savoir si une vidéo, un audio ou une image est un deepfake ?

Les deepfakes peuvent être identifiés grâce à des outils de détection basés sur l'IA qui analysent les incohérences. Cependant, les logiciels de détection de deepfakes recherchent des anomalies dans la symétrie faciale, les clignements des yeux, l'éclairage ou les distorsions d'arrière-plan. De plus, les systèmes avancés peuvent également analyser les métadonnées et détecter des artefacts de manipulation invisibles à l'œil nu. Si la détection manuelle est peu fiable, les solutions automatisées peuvent signaler les contenus synthétiques avec une grande précision.

Qu'est-ce que la vérification biométrique et comment arrête-t-elle les deepfakes ?

La vérification biométrique est un type de vérification d'identité qui authentifie l'identité d'une personne en analysant ses caractéristiques biologiques uniques. Cette vérification prend généralement en compte les traits du visage lors d'une interaction en direct. Elle utilise la détection de présence pour garantir la présence d'une personne réelle. Cela empêche les tentatives d'usurpation d'identité par le biais d'images statiques, de vidéos ou de visages générés par l'IA. Les médias synthétiques ayant du mal à passer ces vérifications en temps réel, la vérification biométrique reste l'un des outils les plus efficaces pour bloquer les deepfakes.

Comment les deepfakes affectent-ils les élections et la démocratie ?

Les deepfakes sont de plus en plus utilisés pour diffuser de faux discours politiques, usurper l'identité de candidats et semer la confusion chez les électeurs. Ils peuvent par exemple usurper l'identité de candidats politiques, diffuser de faux discours et saper la confiance des électeurs. Par conséquent, cela porte atteinte à la légitimité électorale et porte atteinte aux fondements des institutions démocratiques. L'ingérence électorale par le biais des deepfakes est désormais une préoccupation sécuritaire reconnue dans de nombreux pays.

Qu'est-ce qui rend ComplyCube efficace en tant que logiciel de détection de deepfakes ?

ComplyCube combine la vérification de documents par IA, l'authentification biométrique et la vérification d'identité en temps réel pour détecter les fraudes par deepfake. Sa technologie de détection d'activité identifie les supports synthétiques et bloque les identités frauduleuses avant l'intégration. De plus, ComplyCube analyse les documents et les données faciales à la recherche de signes de manipulation, garantissant ainsi la neutralisation des menaces deepfake sans compromettre l'expérience utilisateur ni la conformité. Reconnue par des entreprises internationales, ComplyCube garantit la maîtrise des menaces deepfake sans compromettre l'expérience utilisateur ni la conformité.