Kurz gesagt: Präsentationsangriffserkennung (PAD) hilft dabei, Präsentationsangriffe zu stoppen, die versuchen, die biometrische Verifizierung mit Fälschungen wie z. B. zu täuschen gedruckte Fotos, Masken, Wiederholungen oder Bildschirme. Mit zunehmender Verbreitung von Deepfake-Angriffen und digitalen Einschleusungsmethoden wird PAD immer wichtiger. stärkt Lebendigkeitsentscheidungen Dadurch werden Remote-Onboarding und -Authentifizierung schwieriger zu umgehen.

Presentation Attack Detection (PAD) ist eine Schlüsselkomponente eines robusten biometrischen Verifizierungsprozesses. PAD trägt zur Stärkung der Identitätsüberprüfung bei, indem es Presentation Attacks (PAs) und betrügerische Versuche, unbefugten Zugriff zu erlangen, erkennt. Angesichts der zunehmenden Zahl fortschrittlicher KI-gestützter Deepfake-Angriffe sind PAD-Lösungen für Unternehmen von entscheidender Bedeutung geworden, um ihre Stakeholder und ihren Ruf zu schützen.

In diesem Handbuch werden unterschiedliche Arten von Präsentationsangriffen untersucht und die Notwendigkeit der Implementierung von Lösungen zur Erkennung von Präsentationsangriffen aufgezeigt.

Was ist Präsentationsangriffserkennung?

PAD funktioniert, indem es zwischen authentischen biometrischen Proben, wie dem Gesicht oder Fingerabdruck einer lebenden Person, und Präsentationsangriffsinstrumenten wie gedruckten Fotos, gefälschten Fingerabdrücken, Latexmasken oder digitalen Bildern unterscheidet. Fortgeschrittene PAD-Technologien, wie die Echtheitserkennung, werden eingesetzt, um die Sicherheit biometrischer Authentifizierungsprozesse zu verbessern, die häufig von Finanzinstituten, Strafverfolgungsbehörden und vielen anderen Organisationen verwendet werden.

Die Argumente für die Einführung von PAD werden immer deutlicher, da aktuelle Forschungsergebnisse zeigen, dass 90% aller dokumentenbasierten Betrugspraktiken basieren auf Präsentationsbetrug. Die Verwendung von Deepfakes, die um 704% in den USA im zweiten Halbjahr 2023 allein, weist auf einen kritischen Punkt in der Diskussion hin: Präsentationsangriffe werden immer raffinierter.

Erkennung von Präsentationsangriffen und biometrische Überprüfung

Auch wenn die Gesichtserkennungstechnologie die weltweite Sicherheit massiv verbessert hat, darf man nicht vergessen, dass biometrische Authentifizierung nicht unfehlbar ist. Präsentationsangriffe können Identitätsauthentifizierungsprozesse unterlaufen, indem sie betrügerische Techniken und ausgefeilte Präsentationsangriffsinstrumente verwenden.

Durch die Implementierung von PAD können Organisationen echte Benutzer von Betrügern unterscheiden, indem sie Biometrische Identitätsüberprüfung. Biometrische Daten werden aus bereitgestellten Bildern, Dokumenten und Videos entnommen und mithilfe einer fortschrittlichen KI-Technologie analysiert, die dann durch die Untersuchung von Mikroausdrücken, Hautstruktur und mehr präzise Schlussfolgerungen ziehen kann.

Arten von Präsentationsangriffen

Betrüger verwenden verschiedene Methoden, um die Gesichtserkennungstechnologie zu täuschen, darunter Angriffe mit ausgedruckten Fotos, Videowiedergabeangriffe und 3D-Masken.

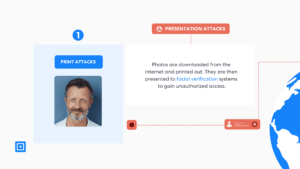

Angriff auf die Präsentation gedruckter Fotos

Druckangriffe sind eine der einfachsten Formen von Präsentationsangriffen. Ohne PAD-Technologie können Angreifer Authentifizierungsprozesse per Gesichtserkennung leicht umgehen, indem sie gedruckte Ausweisdokumente oder Bilder einer anderen Person vorlegen.

Diese Fotos stammen häufig aus sozialen Netzwerken oder sogar aus dem Darknet. Unbefugte Benutzer verschaffen sich Zugriff, indem sie diese biometrischen Gesichtserkennungssysteme unterlaufen und so Identitätsbetrug begehen, da die Gesichtserkennungsfunktion fehlt.

Gelegentlich werden gedruckte Fotos bei diesen Angriffen als Masken verwendet. Betrüger erstellen eine Maske aus einem gedruckten Foto, indem sie Löcher für die Augen ausschneiden, damit diese blinzeln und die Lebenderkennung umgehen können.

Regierungen und Finanzinstitute sind häufig die Hauptziele von Präsentationsangriffen mithilfe gedruckter Fotos, da ihre biometrischen Systeme große Mengen wertvoller Vermögenswerte und Informationen schützen.

Man darf jedoch nicht vergessen, dass jeder das Ziel dieser Angriffe sein kann:

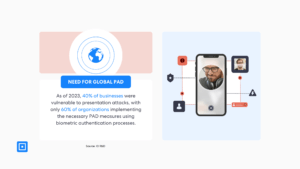

Ab 2023 waren 40% der Unternehmen in den USA anfällig für Präsentationsangriffe, mit nur 60% von Organisationen Umsetzung der notwendigen PAD-Maßnahmen mittels biometrischer Authentifizierungsverfahren.

Replay-Versuche und Deepfake-Angriffe

Bei Replay-Angriffen spielt der Angreifer ein aufgezeichnetes Video ab oder präsentiert dem Gesichtsauthentifizierungssystem auf einem Bildschirm ein digitales Bild. Dieser Angriff kann die natürlichen Bewegungen und Merkmale des Gesichts einer Person sehr gut nachahmen, da Videos Blinzeln und subtile Augenbewegungen erfassen können, um den Eindruck einer lebenden Person zu erwecken.

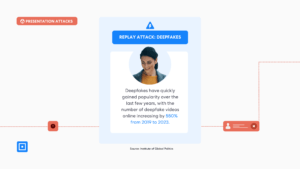

Deepfakes, eine ausgeklügelte Form synthetischer Medien, die bei Präsentationsangriffen verwendet werden, sind auch eine Form von Replay-Angriffen. Sie bestehen aus künstlichen Fotos oder Videos, die durch fortgeschrittenes maschinelles Lernen, sogenanntes „Deep Learning“, erstellt werden. Deep Learning unterscheidet sich vom herkömmlichen maschinellen Lernen, da es mit einer speziellen Klasse von Algorithmen arbeitet, die als neuronales Netzwerk bezeichnet werden und die Art und Weise nachbilden sollen, wie unser Gehirn Informationen speichert. Innerhalb des Netzwerks werden „versteckte Schichten“ von Knoten verwendet, die mathematische Transformationen durchführen, um Eingangssignale in Ausgangssignale umzuwandeln. Im Kontext von Deepfakes werden authentische Bilder in realistische gefälschte Bilder umgewandelt, was Betrügern eine großartige Möglichkeit bietet, Authentifizierungssysteme zu täuschen.

Deepfakes haben in den letzten Jahren schnell an Popularität gewonnen. Die Anzahl der Deepfake-Videos im Internet von 2019 bis 2023 ein Anstieg um 550%.

Um einen Präsentationsangriff zu identifizieren, der Deepfakes nutzt, sind fortgeschrittene PAD-Methoden erforderlich, um subtile Inkonsistenzen wie ungewöhnliche Blinkmuster oder digitale Artefakte zu erkennen.

Das Institute of Global Politics interviewte kürzlich den Journalisten Emanuel Maiberg zum Anstieg von Deep Fakes und erklärte in dem Artikel Folgendes:

„Die jüngsten Fortschritte im Bereich der generativen KI haben alles noch einfacher und realistischer gemacht. Mit der Stable Diffusion-Technologie und anderen Text-zu-Bild-KI-Tools können Sie Fotos von jemandem machen und ein benutzerdefiniertes KI-Modell der Identität dieser Person erstellen.“

3D-Maskenpräsentationsangriff

Zu den Präsentationsangriffsmethoden gehören auch 3D-Maskenangriffe, bei denen Betrüger eine 3D-Maske mit den physischen Merkmalen ihres Opfers präsentieren, um biometrische Systeme zu täuschen, die Gesichtserkennungstechnologie verwenden. Diese Masken werden oft mithilfe eines Abdrucks des Gesichts des Opfers hergestellt, um die biometrischen Gesichtsmerkmale des echten Benutzers mit hoher Präzision nachzubilden.

Fallstudie: Verdacht auf KI-gestützten Hypothekenbetrug bei der Commonwealth Bank of Australia

Im Februar 2026 meldete die Commonwealth Bank of Australia (CBA) potenziell betrügerische Wohnungsbaudarlehen in Höhe von bis zu 1,17 Billionen AUD. Berichten zufolge verwendeten einige Anträge KI-generierte oder manipulierte Dokumente. Der Fall verdeutlicht, wie KI-gestützter Betrug die Kreditvergabe beeinträchtigen kann, wenn keine Kontrollmechanismen gegen Spoofing und moderne Präsentationsangriffe implementiert sind.

Wiederverwendbare, datenschutzkonforme IDV-Lösungen über Grenzen hinweg

Die CBA übergab den Fall der Polizei und den Aufsichtsbehörden und konzentrierte sich auf die Stärkung der Maßnahmen gegen Finanzkriminalität, um dem zunehmenden KI-gestützten Betrug entgegenzuwirken. Ein PAD-basierter Ansatz unterstützt diese Reaktion, indem er die Widerstandsfähigkeit biometrischer Verifizierungen verbessert und Signale für Präsentationsangriffe frühzeitig bei Remote- und Intermediär-basierten Transaktionen erkennt.

Ergebnisse

Bis zu 1,7 Billionen A1T7B1 Milliarden an potenziell betrügerischen Wohnungsbaudarlehen wurden identifiziert und den Behörden gemeldet.

- Die CBA berichtete, im vorangegangenen Geschäftsjahr 900 Millionen A$ investiert zu haben, um Kunden vor Betrug zu schützen.

89% Australier glaubten, sie könnten einen Deepfake erkennen, aber nur 42% konnten dies im Test.

Argumente für die Erkennung von Präsentationsangriffen

Die Erkennung von Präsentationsangriffen ist für die Betrugsprävention von entscheidender Bedeutung und bietet Unternehmen die notwendige Sicherheit, um finanzielle Verluste und Datenlecks zu vermeiden.

Statistische Übersicht zur Erkennung von Präsentationsangriffen

Der Bedarf an Software zur Erkennung von Präsentationsangriffen wird deutlich, wenn man die finanziellen Kosten von Online-Betrug und die große Reichweite betrügerischer Praktiken betrachtet:

Neuere Forschungen haben ergeben, dass Präsentationsangriffe 90% aller dokumentenbasierten betrügerischen Angriffe, was die Notwendigkeit eines robusten biometrischen PAD-Prozesses unterstreicht.

Deepfake-Angriffe und andere fortgeschrittene Formen von Präsentationsangriffen, die Gesichtsidentitätsüberprüfungssysteme unterwandern können, verzeichneten einen echten Anstieg. Allein im Jahr 2023 stieg der Einsatz von Deepfakes zur Täuschung von Gesichtsidentitätsprüfungen von 704% in den USA.

Die Federal Trade Commission gab an, dass amerikanische Verbraucher über Betrug in Höhe von 1TP6B10 Milliarden im Jahr 2023, darunter verschiedene Formen des Identitätsdiebstahls, die durch unzureichende Maßnahmen zur Identitätsüberprüfung begünstigt werden.

Compliance und bewährte Verfahren zur Erkennung von Präsentationsangriffen

Der Rahmen zur Bewertung von Präsentationsangriffen wird entwickelt gemäß ISO/IEC 30107-3:2017.

Durch die Einhaltung der ISO 30107 wird sichergestellt, dass biometrische Systeme genau zwischen echten und gefälschten bzw. veränderten biometrischen Merkmalen unterscheiden können.

Offizielle Websites und verlinkte Quellveröffentlichungen bieten Richtlinien für bewährte Vorgehensweisen bei der Erkennung von Präsentationsangriffen.

Einführung eines biometrischen PAD-Systems zur Identitätsüberprüfung

Die Verwendung der Lebendigkeitserkennung zum Erkennen von Deepfakes, gedruckten Fotos oder anderen PAD-Instrumenten ist für eine starke IDV- und KYC-Lösung für jedes Unternehmen von entscheidender Bedeutung.

Lebendigkeitserkennung

Mithilfe einer Lösung zur Lebendigkeitserkennung wird sichergestellt, dass Ihr Kunde oder Benutzer während des Authentifizierungsvorgangs physisch anwesend und am Leben ist. So wird die Möglichkeit ausgeschlossen, dass über Deepfakes, wiedergegebene Videos oder gefälschte Bilder unbefugter Zugriff erfolgt.

Fortgeschrittene Software zur Erkennung von Präsentationsangriffen sollte eine präzise Echtzeiterkennung zur Authentifizierung von Benutzern umfassen. Um Präsentationsangriffe zu verhindern, Lösungen zur Lebendigkeitserkennung sollte auch in der Lage sein, subtile Mikroausdrücke und Gesichtstexturen zu analysieren, um Pixelmanipulationen oder jegliche Art von Maske zu erkennen.

Mithilfe der Echtheitserkennung lässt sich beispielsweise überwachen, ob die Person, die das Geld überweist, während der Transaktion anwesend ist, und so sicherstellen, dass es sich nicht um einen Identitätsdieb handelt.

Beispielhafte Branchenanwendungen

Finanzdienstleistungen: Schützt vor betrügerischen Transaktionen und Kontoübernahmen, indem sichergestellt wird, dass nur echte, verifizierte und physisch anwesende Benutzer auf vertrauliche Informationen zugreifen können.

Gesundheitspflege: Sichert Patientendaten und identifiziert korrekt Personen, die auf Krankenakten zugreifen.

Grenzkontrolle: Verbessert die Grenzsicherheit durch genaue Überprüfung der Identität von Reisenden und Erkennung gefälschter Dokumente.

Die wichtigsten Erkenntnisse

PAD reduziert das Risiko von biometrischen Spoofing-Angriffen, indem es nicht authentische Eingaben erkennt.

Es sollte physische Spoofing-Angriffe und durch Injektion ausgelöste Deepfake-Versuche erkennen.

Eine starke biometrische Verifizierung kombiniert Lebenderkennung mit Gesichtserkennung.

Mehrere Prüfmechanismen erhöhen die Widerstandsfähigkeit gegen wiederholte Angriffsversuche.

ComplyCube unterstützt PAD-gesteuerte Prüfungen innerhalb von Identitätsabläufen.

Präsentation Angriffserkennung mit ComplyCube

Wir bieten eine marktführende PAD-Lösung, die mithilfe einer KI-gestützten Lebenderkennungsprüfung präzise Gesichtszüge untersucht.

ComplyCubes Identitätsüberprüfungslösungen für PAD

Wir verwenden eine biometrische KI-Engine mit PAD Level 2 ISO-Zertifizierung zur Erkennung von Präsentationsangriffen, indem wir die Echtheit anhand von Datenpunkten zur Gesichtsähnlichkeit zwischen dem übermittelten Video und einem Bild aus einem amtlichen Dokument überprüfen. Darüber hinaus verwenden wir 3D-Gesichtsmapping, um zu überprüfen, ob sich ein Benutzer zuvor mit anderen Angaben registriert hat.

Kontaktieren Sie unser Team von KYC-Spezialisten, um mehr darüber zu erfahren, wie die Erkennung von Präsentationsangriffen Ihre Authentifizierungsprozesse stärken und Ihr Unternehmen schützen kann.

Häufig gestellte Fragen

Was ist Presentation Attack Detection (PAD)?

Die Erkennung von Präsentationsangriffen ist die Fähigkeit biometrischer Systeme, Spoofing-Versuche zu identifizieren und so festzustellen, ob ein präsentiertes Gesicht, ein Fingerabdruck oder ein Merkmal echt und lebendig ist.

Welche Präsentationsangriffe sind gängige Methoden zur Abwehr biometrischer Verifizierung?

Gängige Präsentationsangriffe umfassen Versuche, gedruckte Fotos zu fälschen, maskenbasierte Fälschungen und wiederholte Video- oder Bildschirmübertragungen, die darauf abzielen, Lebendigkeitsprüfungen zu täuschen.

In welchem Zusammenhang stehen Deepfake-Angriffe mit der Erkennung von Präsentationsangriffen?

Deepfake-Angriffe können zur Erzeugung oder Manipulation biometrischer Daten verwendet werden, und aktuelle Bedrohungsberichte zeigen ein rasantes Wachstum von Face-Swap- und Injection-Angriffen, die nur durch PAD und Liveness-Erkennung erkannt werden können.

Worin besteht der Unterschied zwischen PAD und Lebenderkennung?

Die Lebenderkennung wird üblicherweise als Teilbereich der PAD (Personal Access Detection) betrachtet, der sich auf den Nachweis der Anwesenheit einer realen Person konzentriert, während PAD umfassendere Methoden zur Erkennung von Spoofing über verschiedene biometrische Modalitäten hinweg abdeckt.

Wie trägt ComplyCube dazu bei, Präsentationsangriffe bei der biometrischen Verifizierung zu verhindern?

ComplyCube setzt PAD innerhalb seiner Identitätsprozesse ein, um Spoofing-Vektoren zu erkennen und neben der Gesichtsähnlichkeit mit einem Ausweisbild auch Lebendigkeitsergebnisse zurückzugeben, um so nachvollziehbare Onboarding-Entscheidungen zu unterstützen.