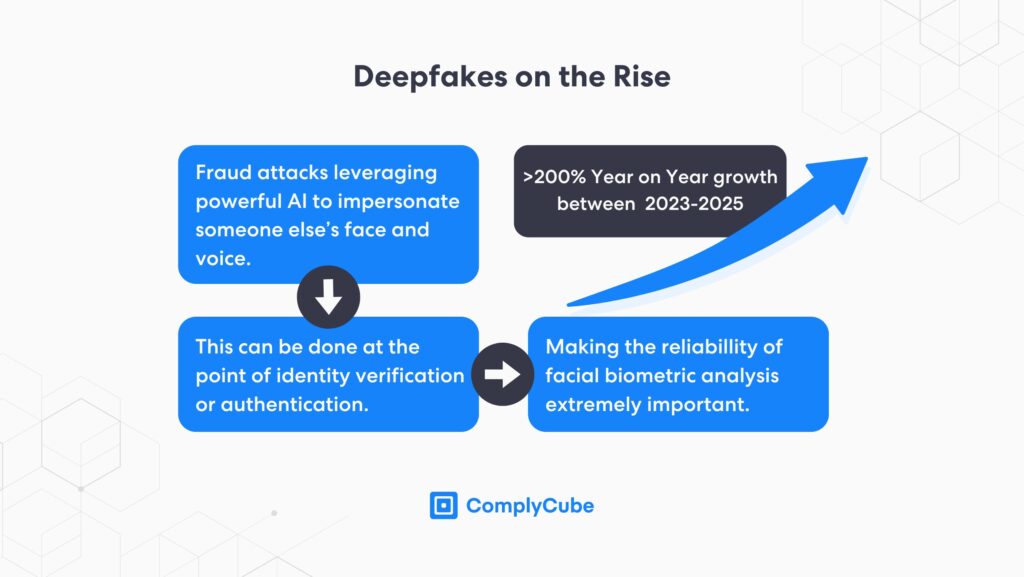

Kurz gesagt: Deepfakes haben sich von KI-Neuheiten zu Ernsthafte Bedrohungs zur globalen Stabilität, Betrug ermöglichen und Fehlinformationen im großen Maßstab. Ihre Auswirkungen auf Wahlen, öffentliches Vertrauen und Unternehmenssicherheit wächst schnell, anspruchsvolle dringende Aufmerksamkeit. Dieser Leitfaden untersucht, wie Deepfake-Erkennungssoftware und Identitätsprüfung oder IDV-Lösungen wie biometrische Verifizierung und Dokumentenverifizierung können helfen Risiken mindern und Schutz der digitalen Integrität.

Was ist ein Deepfake?

Deepfakes verdanken ihren Namen einer Technik der künstlichen Intelligenz (KI), dem sogenannten Deep Learning. Deep-Learning-Algorithmen können sich selbst beibringen, extrem komplexe Probleme zu lösen. Durch die Analyse riesiger Datensätze können sie dann hyperrealistische Inhalte generieren und Gesichter nahtlos in Bilder, Videos, Audiodateien und mehr einfügen.

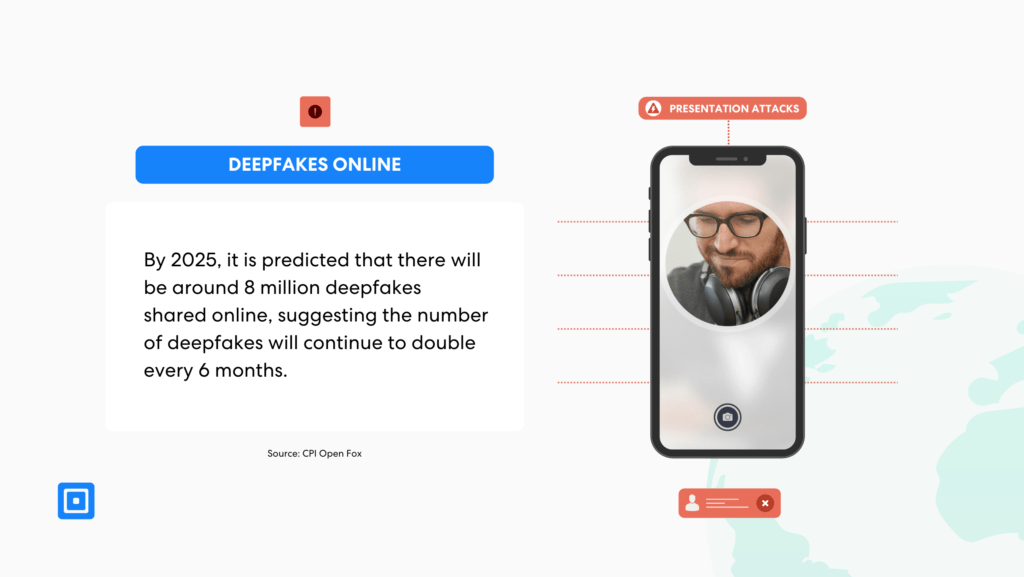

Die Welt steuert rasant auf eine Deepfake-Krise zu. Gleichzeitig wachsen die Bedenken über die Auswirkungen dieser KI-Technologie auf Unternehmen. Tatsächlich verändert sie bereits jetzt die globale sozioökonomische und politische Landschaft. In jüngster Zeit haben sich jedoch die Befürchtungen um die Integrität von Wahlen verstärkt und stehen unter großem Verdacht.

Was ist Deepfake-Erkennung?

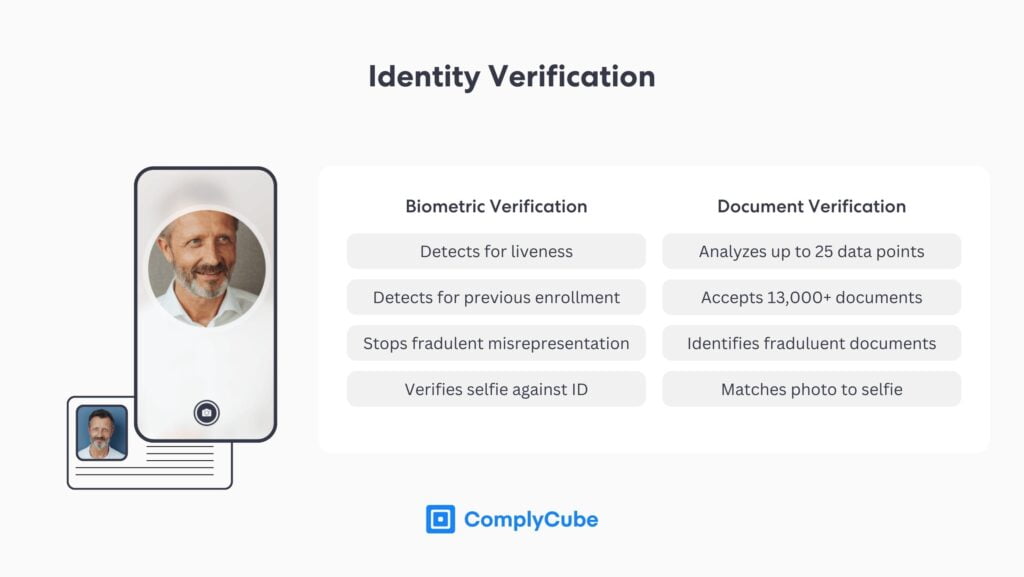

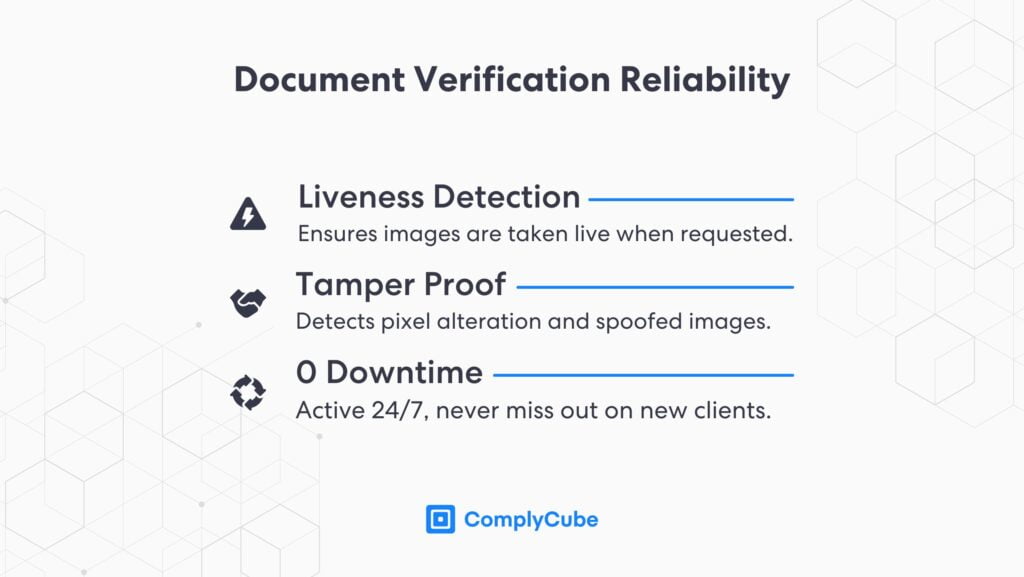

Deepfake-Erkennungssoftware identifiziert Bilder, Töne oder Videos, die künstlich erstellt wurden, um hyperrealistisch auszusehen. Heutzutage integrieren Unternehmen IDV-Lösungen wie Dokumentenüberprüfung und biometrische Verifizierungsprozesse, um Muster zu erkennen, die in „echten Inhalten“ nicht vorhanden wären.

KI-gestützte IDV-Lösungen werden schnell zur einzigen Möglichkeit, Deepfake-Technologien zuverlässig entgegenzuwirken und diese Art von Identitätsbetrug einzudämmen. Im Vergleich zu einem Menschen können diese Technologien gefälschte Inhalte weitaus effektiver identifizieren und in einem bestimmten Zeitraum weitaus mehr Daten verarbeiten, weitaus genauer und weitaus kostengünstiger.

Im September 2023 veröffentlichten drei wichtige Strafverfolgungsbehörden – die National Security Agency (NSA), das Federal Bureau of Investigation (FBI) und die Cybersecurity and Infrastructure Security Agency (CISA) – ein Papier, in dem sie erklärten, dass die Bedrohung durch Deepfakes exponentiell zugenommen habe und automatisierte und präventive Technologien unerlässlich seien.

Bedrohungen durch synthetische Medien wie Deepfakes, haben exponentiell zugenommen.

Angesichts der zunehmenden Bedrohung durch Deepfakes in allen Branchen wird die Identitätsprüfung immer dringlicher. IDV-Lösungen, die Dokumentenprüfung, biometrische Kontrollen und Lebenderkennung kombinieren, stellen heute eine wichtige Verteidigung gegen KI-gesteuerten Betrug dar.

Dokumentenprüfung

Dokumentenprüfung ist einer der beiden wichtigsten Schritte in den Prozessen zur Geldwäschebekämpfung (AML), zur Kundenidentifikation (KYC) und zur Identitätsprüfung (IDV). Es nutzt eine KI-gestützte Verifizierungs-Engine, um KYC-Dokumente, wie z. B. einen Führerschein, in weniger als 15 Sekunden zu lesen. Tatsächlich werden viele Deepfake-Betrugsversuche erst durch Anomalien bei der Dokumentenüberprüfung erkannt. Daher ist dies ein wichtiger Bestandteil jeder Softwaretechnologie zur Deepfake-Erkennung.

Durch die gleichzeitige Überprüfung der Dokumentenauthentizität und die Extraktion der verfügbaren Daten bietet die Dokumentenverifizierung ein hohes Maß an Identitätssicherheit. Sie dient auch als vorläufige Deepfake-Erkennungssoftware und kann künstlich erstellte Bilder von Ausweisen identifizieren. Weitere Informationen zu Gen AI, Dokumentenverifizierung und Deepfake-Erkennungsmethoden finden Sie unter Generative KI: Betrugs- und Identitätsüberprüfung.

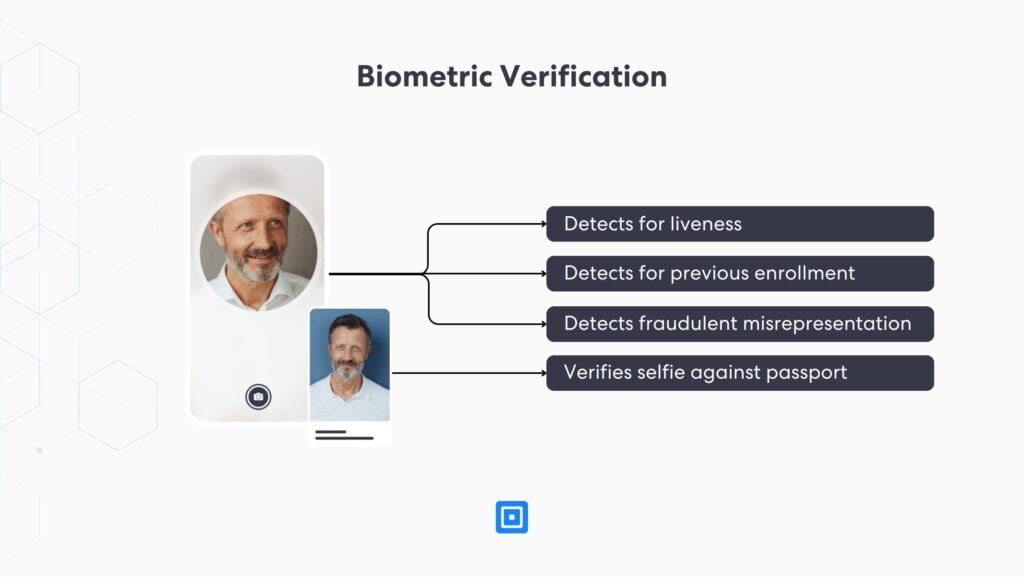

Biometrische Verifizierung

Biometrische Verifizierung verwendet leistungsstarke Technologien zur biometrischen Identifizierung und Gesichtserkennung, um biometrische Daten von Benutzern zu scannen, zu verifizieren und zu authentifizieren. Durch die Analyse biometrischer Informationen wie Gesichtszüge, Mikroausdrücke, Hauttöne und Texturen (manchmal unter Verwendung alternativer Daten wie Iris-Scans) fungiert dieser Prozess als Tool zur Echtheitserkennung und verhindert Präsentationsangriffe wie Deepfakes.

Die biometrische Authentifizierung ist nach wie vor eine der zuverlässigsten Methoden zur Identitätsüberprüfung. Obwohl biometrische Daten selbst mit KI extrem schwer zu fälschen sind, ist das Erkennen von Deepfakes noch immer alles andere als einfach.

Automatisierte IDV-Lösungen spielen eine entscheidende Rolle bei der modernen Identitätsprüfung, Kundenaufnahme und Authentifizierung. Sie ermöglichen es Unternehmen, große Mengen an Prüfungen präzise und skalierbar durchzuführen. Weitere Informationen finden Sie unter Die Vorteile der biometrischen Verifizierung.

Deepfakes und Wahlintegrität

Böswillige Akteure nutzen Deepfakes häufig, um Wahlen zu manipulieren. Sie können falsche Informationen verbreiten und die öffentliche Meinung manipulieren. Das Alan Turing Institute fand heraus, dass fast neun von zehn Menschen befürchten, dass Deepfakes den Wahlausgang beeinflussen könnten.

Diese Sorge spiegelt reale Risiken wider. Kriminelle Akteure haben bereits hochkarätige Deepakfes von Politikern veröffentlicht. Dazu gehören auch gefälschte Audio- und Videoclips mit dem Ziel, die Wähler zu verwirren.

Im Vorfeld der britischen Parlamentswahlen 2024 erstellten unbekannte Akteure Deepfakes, die die Stimmen von Premierminister Rishi Sunak, Labour-Chef Keir Starmer und Londons Bürgermeister Sadiq Khan imitierten. Sie verbreiteten diese Clips in den sozialen Medien, erreichten Hunderttausende potenzielle Wähler und schürten in der Öffentlichkeit falsche Vorstellungen.

Zu diesen Manipulationen gehörten gefälschte Korruptionsskandale und irreführende Behauptungen über politische Positionen und Absichten. Infolgedessen können solche Inhalte ernsthaften Schaden anrichten, insbesondere wenn die Wähler Schwierigkeiten haben, Echtes von Falschem zu unterscheiden.

Deepfake-Erkennung und Reaktion

Die Erkennung von Deepfakes wird immer schwieriger, selbst für Technologiegiganten wie Meta, Google und Microsoft, die sich alle verpflichtet haben, betrügerische KI bei Wahlen zu bekämpfen. Die Herausforderung ergibt sich aus der zunehmenden Komplexität generativer KI-Tools, die mittlerweile kaum noch von der Realität zu unterscheidende Ergebnisse produzieren. Unternehmen müssen IDV-Lösungen und Echtzeit-Erkennungs-APIs integrieren, um Bedrohungen zu stoppen, bevor sie sich ausbreiten.

So hat beispielsweise Nick Clegg, Präsident von Meta für globale Angelegenheiten, die Herausforderungen bei der Identifizierung von KI-generierten Inhalten festgestellt. Betonung der Tatsache, dass böswillige Akteure unsichtbare Markierungen entfernen können, die normalerweise auf Manipulation hinweisen.

Die Bedrohung durch Deepfakes ist global. Sie scheint sogar internationale Ereignisse zu verfolgen. In Amerika imitieren Deepfakes Die Stimme von Präsident Joe Biden wurde in einem Robocall verwendet, um falsche Informationen über die Wahl zu verbreiten. Dieser Vorfall verdeutlicht das Potenzial von Deepfakes, die Wahlbeteiligung zu senken.

Diese Herausforderung geht über die bloße Erkennung hinaus. Sobald sich ein Deepfake verbreitet, richtet er oft Schaden an, bevor Faktenprüfer ihn entlarven können. Plattformen müssen handeln, bevor betrügerische Inhalte veröffentlicht werden. Soziale Netzwerke wie X (ehemals Twitter), Facebook und Instagram sollten Deepfake-Erkennungssoftware mit Scan-Funktionen vor dem Hochladen und Echtzeit-Live-Erkennung über SDKs und APIs einsetzen.Weitere Informationen finden Sie unter Integration mit einem Liveness Detection SDK.

Deepfake-Erkennung bei der Identitätsüberprüfung

Über soziale Medien hinaus sind Deepfakes branchenübergreifend zu einem wichtigen Betrugsvektor geworden. Sie stellen heute ein erhebliches Betrugsrisiko im Finanzdienstleistungssektor dar, von Banking- und Handels-Apps bis hin zu Krypto-Plattformen und Zahlungsdiensten. Kriminelle nutzen Deepfakes täglich, um IDV zu umgehen, Gelder abzuheben und Konten bei Kreditgebern zu eröffnen.

Generative KI stellt die größte Bedrohung für die [Finanz-]Industrie dar, Dadurch könnten die Betrugsverluste in den USA bis 2027 auf $40bn ansteigen, gegenüber $12,3 Mrd. im Jahr 2023.

Diese Prognose legt nahe, dass Deepfake-Betrug innerhalb von vier Jahren um über 2001 TP6T zunehmen und sich zum Haupttreiber der globalen Finanzkriminalität entwickeln könnte. Um diesen Anstieg zu verhindern, müssen Unternehmen in fortschrittliche Deepfake-Erkennungssoftware investieren, die synthetische Inhalte erkennen kann, bevor sie zu finanziellen Verlusten führen.

Vertrauensverlust durch betrügerische Technologie

Über Wahlen hinaus stellt die Verbreitung von Deepfakes eine umfassendere Bedrohung für das öffentliche und private Vertrauen in Informationen und Identität dar. Mit der zunehmenden Verbreitung der Deepfake-Technologie werden die Menschen gegenüber den Medien, die sie konsumieren, zunehmend skeptischer. Diese Skepsis gegenüber den Medien könnte zu einem Phänomen führen, das als Lügnerdividende, Die Möglichkeit gefälschter Inhalte ermöglicht es Einzelpersonen, diese glaubhaft zu leugnen, wodurch Verantwortlichkeit und Wahrheit untergraben werden. IDV-Lösungen könnten Unternehmen dabei helfen, Wahrheit von Lüge zu unterscheiden und so das digitale Vertrauen in einem Zeitalter der KI-Täuschung wiederherzustellen.

Ein häufiges Beispiel für dieses Phänomen ist die schädliche Berichterstattung über eine Persönlichkeit des öffentlichen Lebens, einen Politiker oder einen Wirtschaftsführer in den Medien. Skepsis gegenüber authentischen Medien ermöglicht es diesen Personen, diese öffentliche Meinung zu nutzen und zu behaupten, sie sei nicht echt. Es ist leicht zu erkennen, wie dieser Effekt anwachsen kann.

Fallstudie: Arup CEO Deepfake-Betrug und Betrug im Wert von $25 Millionen

Anfang 2025 nutzten Cyberkriminelle generative KI, um sich während eines gefälschten Videoanrufs mit einem Finanzmitarbeiter im Hongkonger Büro des Unternehmens als hochrangige Arup-Führungskräfte, darunter auch der CEO, auszugeben. Der Mitarbeiter glaubte, die Anfrage sei legitim, und überwies 1725 Millionen US-Dollar auf von den Betrügern kontrollierte Konten.

Das Deepfake-Video spiegelte Arups internen Kommunikationsstil wider und zeigte mehrere künstliche „Führungskräfte“. Die Angreifer hatten die Hierarchie und Arbeitsabläufe des Unternehmens studiert und Deepfake-Technologie mit gezieltem Social Engineering kombiniert. Der Mitarbeiter sah daher keinen Grund, die Interaktion zu hinterfragen. Als die Identitätsprüfung den Betrug aufdeckte, waren die Gelder bereits unwiederbringlich.

Dieser Fall unterstreicht, wie leicht Deepfakes herkömmliche Verifizierungsmethoden umgehen können. Daher müssen Unternehmen biometrische IDV-Lösungen in Echtzeit mit Echtzeit-Verifizierung und Deepfake-Erkennungssoftware einsetzen, um solchen Bedrohungen entgegenzuwirken. Der Arup-Vorfall ist eine deutliche Warnung: Selbst global agierende, gut ausgestattete Unternehmen sind weiterhin anfällig für Deepfake-Betrug.

Vertrauen im großen Maßstab aufbauen mit Software zur Deepfake-Erkennung

Obwohl die Gefahren von Deepfakes bekannt sind, sind die regulatorischen Reaktionen weiterhin lückenhaft. In den USA fehlt es noch an einer landesweiten Gesetzgebung, doch mindestens 20 Bundesstaaten haben bereits Gesetze gegen wahlbezogene Deepfakes erlassen. Eine flächendeckende Strategie auf Bundesebene steht jedoch noch aus. Inzwischen Abteilung für Das Finanzministerium hat automatisierte Technologien wie die biometrische Verifizierung und die Dokumentenverifizierung als einige der wirksamsten Instrumente zur Verhinderung und Bekämpfung neuer Betrugsmethoden anerkannt.

Auch in Großbritannien sind die Fortschritte begrenzt. Zwar ist die Erstellung und Verbreitung schädlicher persönlicher Deepfakes gesetzlich verboten, umfassendere Regelungen gegen deren Einsatz zur Wahlmanipulation wurden jedoch noch nicht erlassen.

Derzeit liegt es in der Verantwortung jedes Unternehmens, IDV-Lösungen zu implementieren, die Software zur Deepfake-Erkennung als zentrales Instrument zur Bekämpfung von Deepfake-Betrug beinhalten. Darüber hinaus müssen Unternehmen bei der Entwicklung einer Anti-Geldwäsche-Strategie (AML) Deepfake-Bedrohungen in ihrem risikobasierten Ansatz (RBA) berücksichtigen.

Die wichtigsten Erkenntnisse

- Deepfakes befeuern einen Anstieg des Identitätsbetrugs, wobei Standard-IDV-Lösungen umgangen werden.

- Die Integrität der Wahlen ist zunehmend gefährdet, da synthetische Medien zur Verbreitung von Desinformationen und zur Manipulation der öffentlichen Wahrnehmung verwendet werden.

- Biometrische Verifizierung spielt eine entscheidende Rolle im Kampf gegen Deepfakes, mithilfe von Gesichtserkennung, Lebenderkennung und Mikroausdrucksanalyse.

- KI-gestützte Dokumentenprüfung ist unerlässlich, um gefälschte oder synthetische Ausweise zu erkennen, wodurch Unternehmen die Echtheit von Dokumenten überprüfen können.

- ComplyCube bietet eine einheitliche Plattform das Identitätsprüfung, Dokumentenprüfung und Deepfake-Erkennungssoftware für umfassenden Betrugsschutz integriert.

Über ComplyCube

Um KI-gesteuertem Betrug entgegenzuwirken, sind Deepfake-Erkennungssoftware und IDV-Lösungen unverzichtbar geworden. Diese Tools nutzen generative KI, um dieselben Datenmuster zu analysieren, die zur Erstellung von Deepfakes verwendet werden. So können synthetische Inhalte erkannt und Betrug verhindert werden. Die Dokumenten- und biometrischen Verifizierungslösungen von ComplyCube spielen dabei eine Schlüsselrolle und ermöglichen es Organisationen weltweit, Benutzer zu authentifizieren und Deepfake-Versuche zu blockieren.

Der führende Anbieter von IDV-Lösungen wurde gegründet, um die wachsenden Bedrohungen durch innovative Betrugsmethoden im 21. Jahrhundert zu bekämpfen. Durch den Einsatz fortschrittlicher KI- und maschineller Lernalgorithmen bietet die Plattform von ComplyCube umfassende IDV- und biometrische Verifizierungsdienste und gewährleistet so einen robusten Schutz vor Identitätsbetrug und Deepfake-Inhalten.

Mit einer flexiblen und anpassbaren Lösung können ihre Dienste entsprechend der RBA eines Unternehmens angepasst werden, um Unternehmen dabei zu helfen, ihre Sicherheitsprotokolle zu verbessern, die Einhaltung gesetzlicher Standards aufrechtzuerhalten und das Vertrauen ihrer Kunden in einer zunehmend digitalen Welt aufzubauen. Weitere Informationen finden Sie unter Kontaktieren Sie noch heute einen Compliance-Spezialisten.

Häufig gestellte Fragen

Was ist ein Deepfake und wie funktioniert er?

Ein Deepfake ist eine Form synthetischer Medien wie Videos, Bilder oder Audiodateien, die mithilfe von Deep-Learning-Algorithmen erstellt werden. Diese KI-Systeme trainieren anhand großer Datensätze, um subtile menschliche Merkmale wie Gesichtsausdrücke und Sprachmuster zu replizieren. Dadurch können Deepfakes die Stimmen, Gesichter und Verhaltensweisen realer Menschen überzeugend nachahmen. Bedrohungsakteure nutzen sie häufig, um Fehlinformationen zu verbreiten, sich als andere Personen auszugeben oder Identitätsbetrug zu begehen.

Wie können Sie erkennen, ob es sich bei einem Video, Audio oder Bild um einen Deepfake handelt?

Deepfakes können mithilfe KI-gestützter Erkennungstools identifiziert werden, die auf Inkonsistenzen analysieren. Deepfake-Erkennungssoftware sucht jedoch nach Anomalien in Gesichtssymmetrie, Blinzelmustern, Beleuchtung oder Hintergrundverzerrungen. Darüber hinaus können fortschrittliche Systeme auch Metadaten scannen und Manipulationsartefakte erkennen, die für das menschliche Auge unsichtbar sind. Während die manuelle Erkennung unzuverlässig ist, können automatisierte Lösungen synthetische Inhalte mit hoher Genauigkeit kennzeichnen.

Was ist biometrische Verifizierung und wie verhindert sie Deepfakes?

Die biometrische Verifizierung ist eine Form der Identitätsprüfung, die die Identität einer Person durch die Analyse einzigartiger biologischer Merkmale authentifiziert. Bei dieser Verifizierung werden in der Regel Gesichtszüge während einer Live-Interaktion berücksichtigt. Mithilfe der Lebenderkennung wird die Anwesenheit eines echten Menschen sichergestellt. Dies verhindert Spoofing-Versuche mit statischen Bildern, Videos oder KI-generierten Gesichtern. Da synthetische Medien diese Echtzeitprüfungen nur schwer bestehen, bleibt die biometrische Verifizierung eines der effektivsten Mittel zur Blockierung von Deepfakes.

Welchen Einfluss haben Deepfakes auf Wahlen und die Demokratie?

Deepfakes werden zunehmend eingesetzt, um falsche politische Narrative zu verbreiten, sich als Kandidaten auszugeben und Wähler zu verwirren. Sie können sich beispielsweise als politische Kandidaten ausgeben, falsche Narrative verbreiten und das Vertrauen der Wähler untergraben. Dies untergräbt die Legitimität von Wahlen und beschädigt die Grundlagen demokratischer Institutionen. Wahlmanipulation durch Deepfakes ist mittlerweile in vielen Ländern ein anerkanntes Sicherheitsrisiko.

Was macht ComplyCube als Deepfake-Erkennungssoftware so effektiv?

ComplyCube kombiniert KI-gestützte Dokumentenprüfung, biometrische Authentifizierung und Echtzeit-Identitätsprüfung, um Deepfake-basierten Betrug zu erkennen. Die Liveness-Erkennungstechnologie kennzeichnet synthetische Medien und stoppt betrügerische Identitäten bereits vor dem Onboarding. Darüber hinaus analysiert ComplyCube sowohl Dokumente als auch Gesichtsdaten auf Anzeichen von Manipulation und stellt so sicher, dass Deepfake-Bedrohungen neutralisiert werden, ohne die Benutzererfahrung oder Compliance zu beeinträchtigen. ComplyCube genießt das Vertrauen globaler Unternehmen und stellt sicher, dass Deepfake-Bedrohungen entschärft werden, ohne die Benutzererfahrung oder Compliance zu beeinträchtigen.